L’intelligenza artificiale sta cambiando il mondo più in fretta di qualsiasi tecnologia prima. Il rapporto annuale dell’AI Index 2026 di Stanford HAI fotografa lo stato di adozione, investimenti, capacità dei modelli, impatto sul lavoro e costo ambientale. Ne emerge una situazione complesso.

C’è una frase con cui Stanford HAI ha aperto la comunicazione del suo rapporto 2026 che vale la pena riportare, perché contiene già la chiave di lettura di tutto il resto: “Se state seguendo le notizie sull’IA, probabilmente avete il capogiro. L’IA è una corsa all’oro. L’IA è una bolla. L’IA vi sta rubando il lavoro. L’IA non sa ancora leggere un orologio analogico.”

E il rapporto, nelle sue 400 pagine, prova a rispondere a tutte queste domande insieme, con dati verificati.

È il nono anno consecutivo che lo Stanford HAI, istituto di ricerca sull’intelligenza artificiale fondato all’interno dell’università californiana, pubblica questo documento. Ed è probabilmente, al momento, la fonte più autorevole e indipendente che esista su questo tema, perché non è prodotta da un laboratorio con un interesse diretto nei risultati. Per questo assume una notevole importanza.

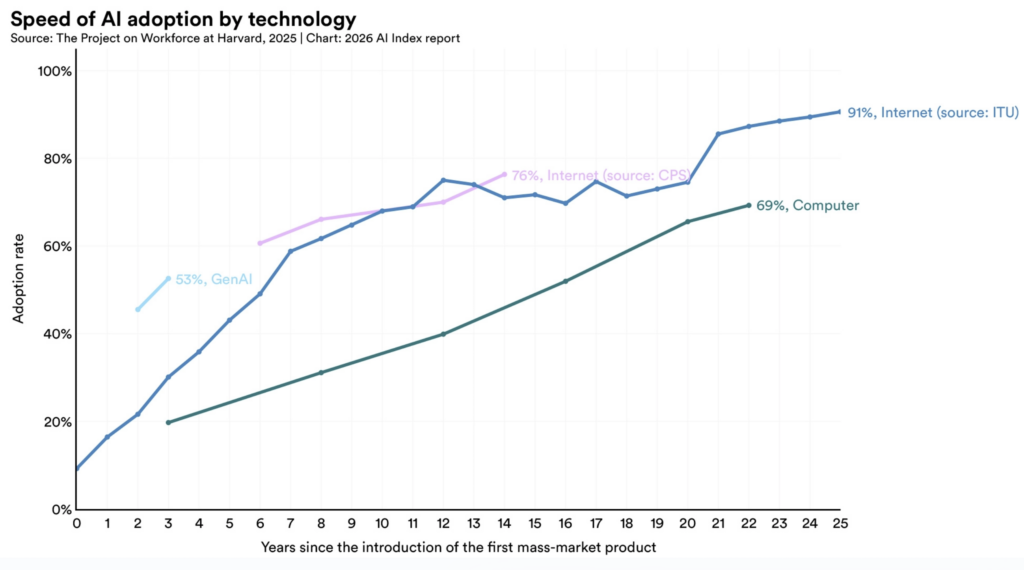

IA, una velocità di adozione mai vista prima

Partiamo dal dato più impressionante, quello che ci permette di mettere in prospettiva tutto il resto del rapporto

Secondo l’AI Index 2026, l’IA generativa ha raggiunto il 53% di adozione globale in soli tre anni dal suo lancio di massa. Per capire cosa significa, basta un confronto: il personal computer ha impiegato molto più tempo per raggiungere una penetrazione analoga nella popolazione mondiale. Internet anche. Gli smartphone, che pure avevano trasformato la vita quotidiana di miliardi di persone, ci hanno messo circa un decennio.

Il personal computer ha impiegato circa 16 anni per raggiungere il 50% di adozione nei paesi industrializzati, internet circa 7 anni.

L’IA generativa ci è arrivata in tre anni, e lo ha fatto quasi gratis. La maggior parte degli strumenti che la gente usa ogni giorno, va detto, è accessibile in forma gratuita o quasi gratuita.

Ma, va detto, l’adozione non è uniforme e non segue le logiche che ci si potrebbe aspettare.

Singapore guida la classifica con il 61%, gli Emirati Arabi si collocano secondi al 54%. Gli Stati Uniti, con tutti i loro investimenti e con tutti i modelli che producono, si trovano “solo” al 24° posto con il 28,3%.

Questo ci suggeriscie che non è detto che chi costruisce la tecnologia sia chi la adotta più in fretta. Spesso chi parte con meno vincoli strutturali si muove con più agilità.

IA e la crescita degli investimenti, l’assenza dell’UE

Gli investimenti globali in intelligenza artificiale nel 2025 hanno raggiunto i 581,7 miliardi di dollari, più che raddoppiando rispetto all’anno precedente. Gli investimenti privati sono cresciuti del 127,5%, arrivando a 344,7 miliardi, e le sole aziende di IA generativa hanno assorbito quasi la metà di quel totale.

Ma quello che è più interessante è la distribuzione geografica di questi investimenti.

Gli Stati Uniti guidano con 285,9 miliardi di dollari di investimenti privati, una cifra 23 volte superiore a quella della Cina, che si ferma a 12,4 miliardi. Anche qui, però, il rapporto invita alla cautela: i fondi governativi cinesi, che non compaiono nelle statistiche degli investimenti privati, avrebbero immesso nell’IA circa 184 miliardi di dollari solo tra il 2000 e il 2023. Il confronto diretto, quindi, rischia di essere fuorviante.

E l’Europa? Qui i numeri sono sensibilmente inferiori.

Tra il 2013 e il 2024, il capitolo dedicato alla governance e alle politiche pubbliche cita gli investimenti statali in IA dei principali paesi: il Regno Unito con 1,6 miliardi di dollari, la Germania con 505 milioni, la Francia con 320 milioni. L’Italia non compare.

Quello che colpisce non è solo la modestia delle cifre europee rispetto agli Stati Uniti, ma è la frammentazione con cui ci si muove su questo terreno. Ogni paese va per conto suo, con strategie nazionali che si sovrappongono, senza coordinarsi in modo efficace.

L’UE ha una voce autorevole sulla regolamentazione, ha prodotto l’AI Act, gode di un livello di fiducia più elevato rispetto agli USA e alla Cina nella capacità di governare il fenomeno. Ma sul fronte degli investimenti e della produzione di modelli, l’Europa rimane largamente assente.

IA e i modelli europei che non ci sono

Ed è qui che arriviamo al punto più dolente per chi guarda il fenomeno dall’Europa.

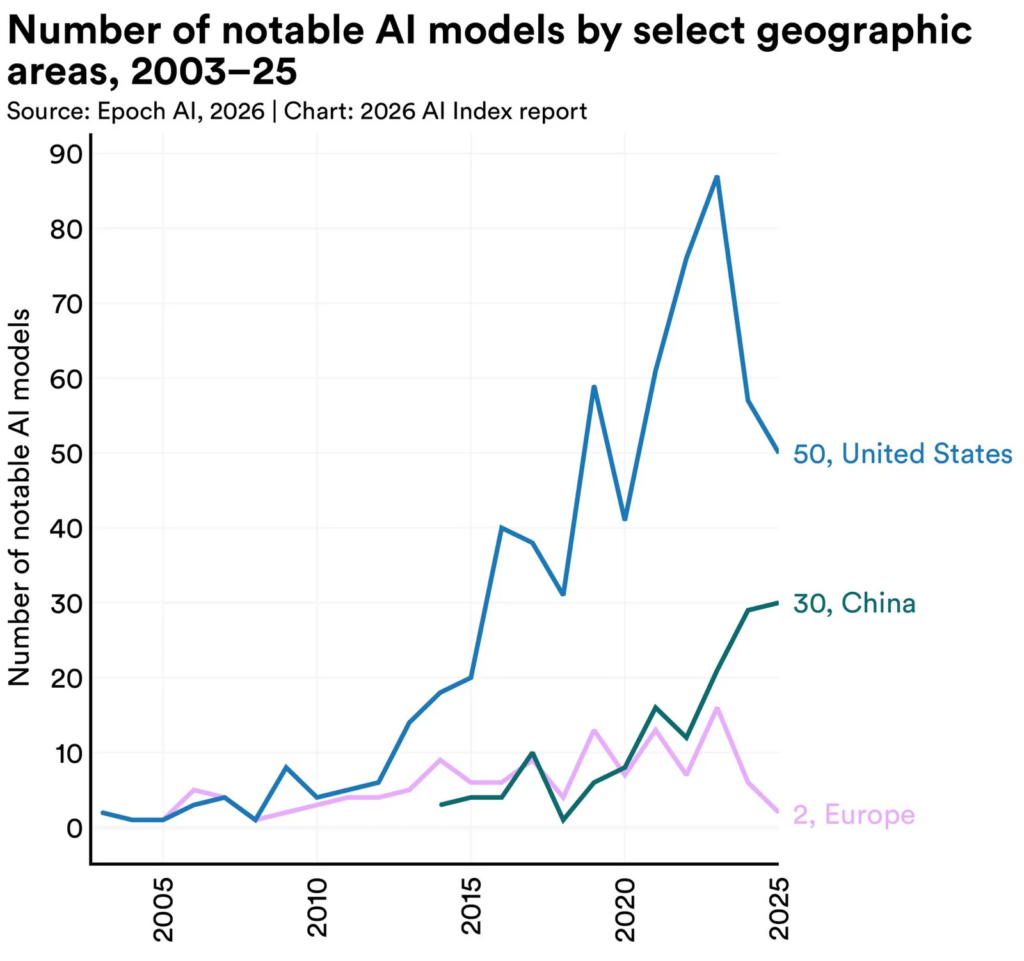

Tra i modelli più rilevanti del 2025, quelli che il rapporto identifica come “rilevanti”notable” per le loro capacità, gli Stati Uniti ne hanno rilasciati 50, la Cina 30. L’Europa non compare.

Si tratta di modelli di frontiera, quelli che spostano le capacità verso l’alto e che definiscono lo stato dell’arte. E in quella classifica, il continente europeo semplicemente non esiste come attore.

Più del 90% di tutti i modelli rilevanti è prodotto da aziende private, e tra quelle aziende non ce n’è nessuna con sede in Europa che riesca a competere con OpenAI, Anthropic, Google, xAI o DeepSeek.

Mistral, l’unica azienda europea che produce modelli di frontiera, non compare nella lista dei modelli più significativi dell’anno secondo la classificazione Epoch AI utilizzata dal rapporto Stanford.

Cosa sa fare l’IA, e cosa non sa ancora fare

Il rapporto offre su questo punto una lettura molto più sfumata di quanto i comunicati stampa dei vari laboratori lascino intendere.

Stanford definisce la situazione attuale con una formula: “jagged frontier”, frontiera frastagliata.

I modelli di punta battono i professionisti umani su domande di scienze a livello di dottorato, vincono medaglie d’oro alle olimpiadi internazionali di matematica, risolvono problemi di coding su SWE-bench con prestazioni che in un solo anno sono passate dal 60% a quasi il 100% del livello umano.

Ma, nonostante tutto, lo stesso modello che vince quella medaglia d’oro riesce a leggere correttamente un orologio analogico solo il 50,1% delle volte.

Una contraddizione che in realtà ci dice molto sula natura stessa di questi sistemi. E quindi eccellono in domini ben definiti, su compiti che assomigliano a quelli su cui sono stati addestrati, e faticano su altri che sembrano banali per un bambino di dieci anni.

Questo non significa che siano inutili, anzi. Significa che chi li usa deve sapere dove funzionano meglio e dove no. E significa che i benchmark di marketing, quelli che le aziende usano per annunciare prestazioni record, spesso misurano cose molto lontane da ciò che conta davvero nel lavoro e nella vita reale.

C’è un altro elemento che il rapporto segnala. Secondo il Foundation Model Transparency Index, l’indice che misura il grado di apertura dei laboratori sui propri sistemi, il punteggio medio è sceso da 58 a 40 nell’arco di un anno.

Google, Anthropic e OpenAI hanno smesso di comunicare le dimensioni dei dataset e la durata degli addestramenti per i loro ultimi modelli. In buona sostanza: i modelli più capaci sono anche quelli che rivelano di meno su come funzionano.

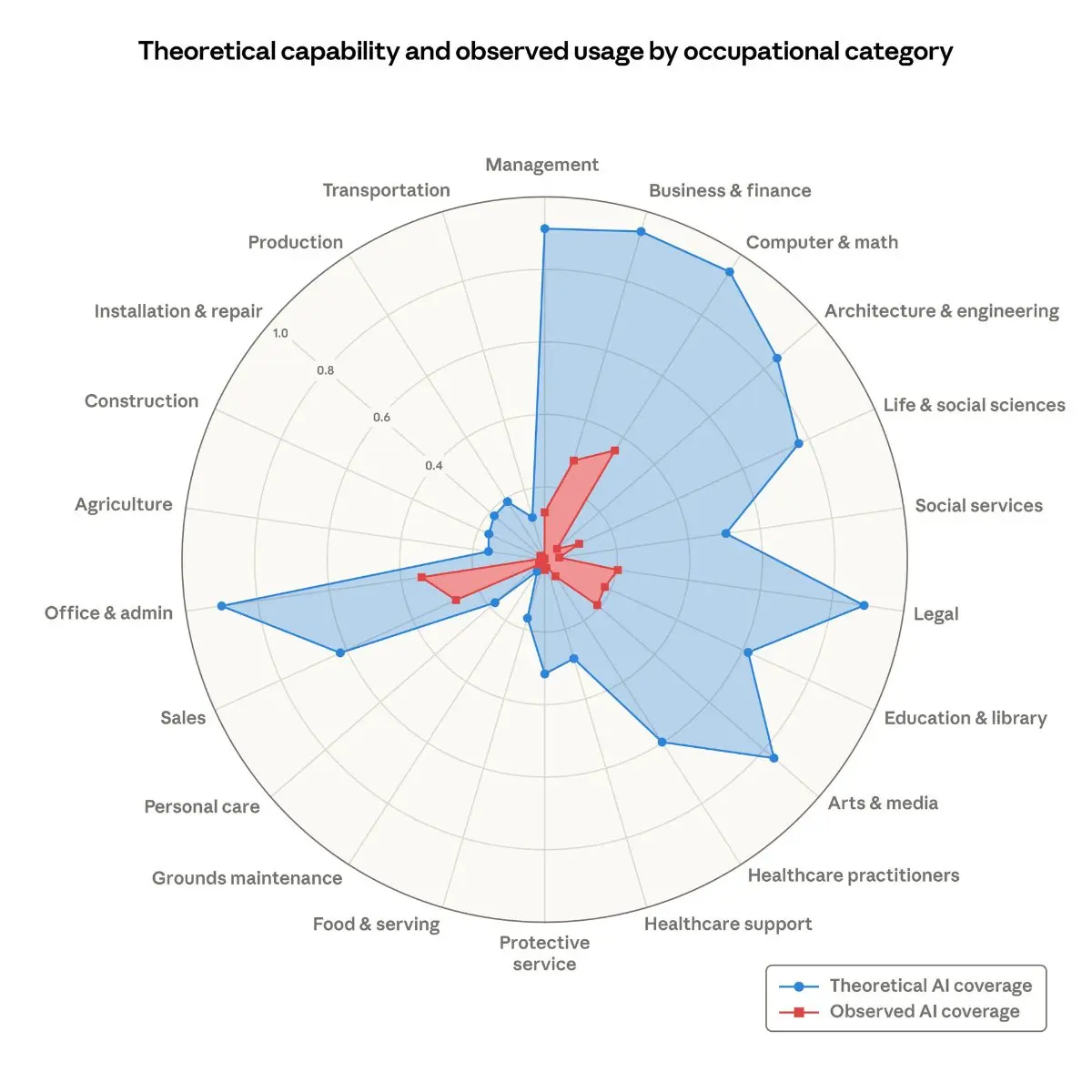

IA e il lavoro, chi perde e chi guadagna

Il rapporto dedica ampio spazio all’impatto dell’IA sul lavoro, e anche qui la lettura è meno lineare di quanto la narrazione diffusa suggerisca.

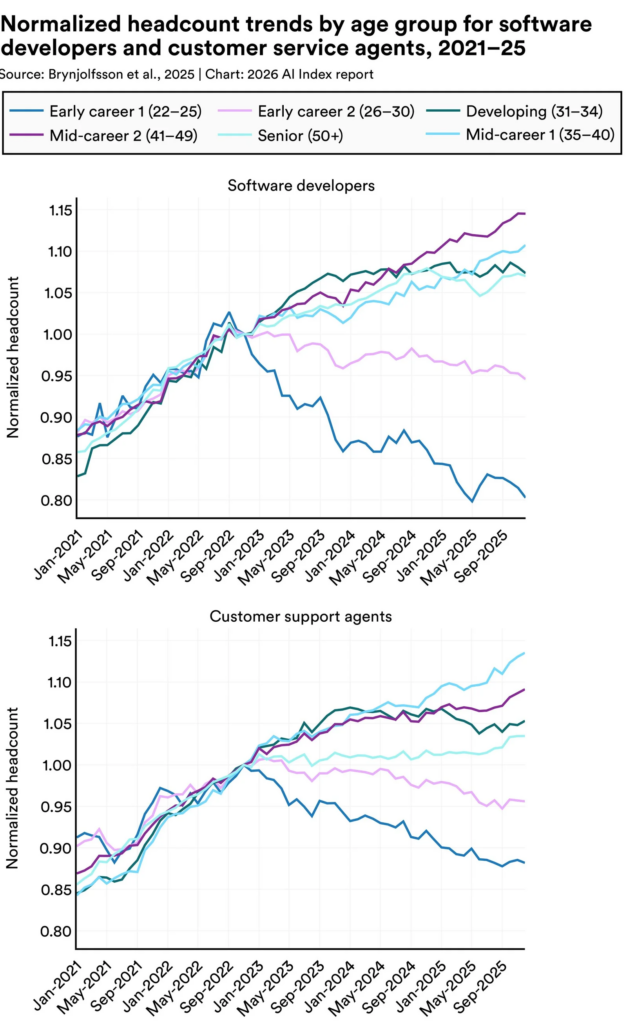

Da una parte, i guadagni in termini di produttività documentati sono reali: 14-15% nell’assistenza clienti, 26% nello sviluppo software, fino al 73% nei team di marketing.

Dall’altra, quei guadagni non sono distribuiti in modo uniforme. Gli sviluppatori statunitensi tra i 22 e i 25 anni hanno visto la propria occupazione calare di quasi il 20% in un anno, mentre i colleghi più senior ha fatto registrare il dato opposto. Il discorso è sempre lo stesso: l’IA sostituisce l’ingresso, non l’esperienza di lavoro. E un terzo delle organizzazioni intervistate dichiara di aspettarsi riduzioni del personale nei prossimi dodici mesi.

In aggiunta a questo, il 73% degli esperti di IA è ottimista sull’impatto della tecnologia sul lavoro. Ma solo il 23% delle persone in generale condivide questa visione.

Questa frattura tra chi costruisce il futuro e chi ne subisce in qualche modo le conseguenze non è un problema di comunicazione, è solo un problema di fiducia.

IA e il costo che nessuno vuole calcolare

C’è infine un capitolo del rapporto su cui mi soffermo, perché è quello che rischia di passare in secondo piano rispetto alle notizie sulle prestazioni e sugli investimenti. A dire il vero, è uno dei temi più trascurati in questa fase, anche se è quello forse più importanti. Perché riguarda davvero tutti.

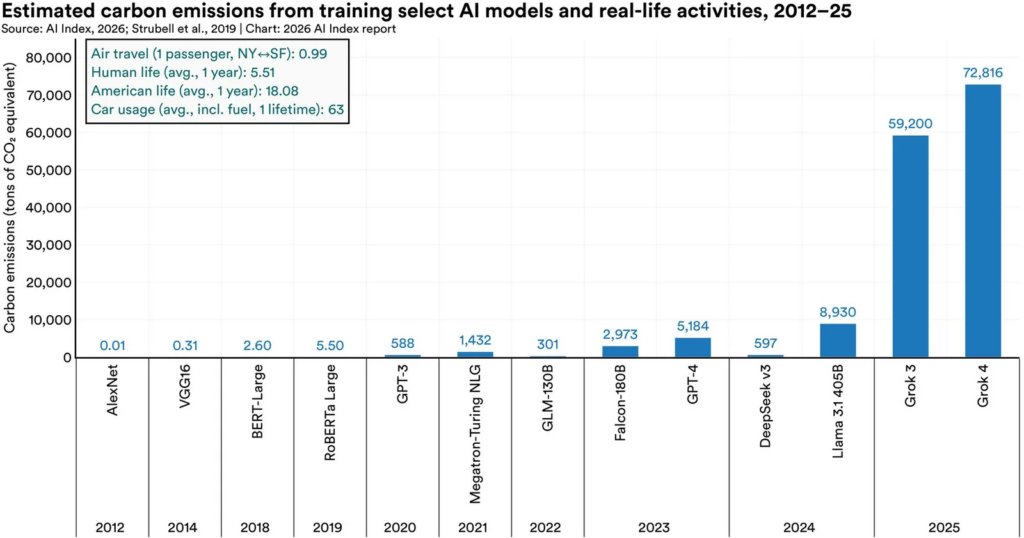

L’impronta ambientale di questa evoluzione tecnologica trainata dalla IA non è più un incidente di percorso, ma una costante strutturale.

Addestrare Grok 4, il modello di xAI, ha generato un’emissione stimata di 72.816 tonnellate di CO2 equivalente, pari alle emissioni di 17.000 automobili che circolano per un intero anno.

L’addestramento di GPT-4 è stimato a 5.184 tonnellate di CO2 equivalente, quello di Llama 3.1 405B di Meta a 8.930 tonnellate.

La capacità installata dei data center dedicati all’IA ha raggiunto i 29,6 gigawatt, all’incirca la stessa quantità di energia necessaria per alimentare l’intero stato di New York al picco della domanda.

E il solo consumo d’acqua per il raffreddamento dei server legato all’inferenza di GPT-4o potrebbe superare il fabbisogno idrico annuo di 12 milioni di persone.

Per dare un riferimento ancora più concreto e diretto: la domanda energetica cumulativa di tutti i sistemi di IA nel mondo è oggi paragonabile al consumo elettrico nazionale di Svizzera o Austria.

Questi numeri crescono insieme ai modelli. E il rapporto di Stanford osserva che i miglioramenti nell’efficienza hardware non hanno tenuto il passo con la scala delle nuove distribuzioni.

In buona sostanza: stiamo diventando più bravi a costruire modelli più potenti molto più in fretta di quanto stiamo diventando bravi a farlo in modo sostenibile.

Resta da vedere come il dibattito pubblico e politico saprà reggere il confronto con questa velocità.

Per adesso, il rapporto di Stanford ci dice che la tecnologia sta correndo mentre le istituzioni camminano. E il divario tra le due andature è, in questo momento, il problema più grande di tutti da affrontare.