Si è aperto a Oakland il processo Musk-Altman. Restano in piedi solo due accuse: violazione del vincolo non profit e arricchimento ingiustificato. In gioco c’è la rimozione di Altman, l’annullamento della conversione di OpenAI in società a scopo di lucro e una restituzione fino a 134 miliardi. Il verdetto atteso a metà maggio.

Solo fino a qualche anno fa, nessuno avrebbe mai creduto che Elon Musk avrebbe finito per portare in tribunale Sam Altman per annullare la leadership di OpenAI e per ricondurre la stessa azienda al suo obiettivo originale, ossia quella di società senza scopo di lucro. Oltre alla restituzione di diverse decine di miliardi di dollari.

Nessuno ci avrebbe creduto, ma da oggi è davvero così. La sintesi non regge in realtà perché il caso arrivato presso l’aula del tribunale federale di Oakland si è trasformato nel corso di questi mesi e resta comunque complesso.

Cerchiamo di capire perché si è arrivati a questo punto e qual è la posta in gioco. L’esito di questo processo non è scritto da nessuna parte, perché si tratta di una questione che riguarda direttamente Elon Musk e Sam Altman. Ma visto il ruolo che oggi giocano questi miliardari, è lecito sostenere che l’esito di questo processo avrà effetti sul futuro dell’intelligenza artificiale.

La storia inizia oltre 10 anni fa, quando una promessa arriva poi a valere svariati miliardi di dollari e riguarda da vicino il futuro dell’IA. Elon Musk e Sam Altman dieci anni fa avevano firmato la stessa dichiarazione di intenti, e oggi si trovano in tribunale per stabilire chi di loro due l’ha, infine, tradita. Musk sostiene senza mezzi termini che a tradire è stato Altman.

La giudice Yvonne Gonzalez Rogers ha avviato la selezione e l’insediamento dei nove giurati (così come prevede l’ordinamento americano) che ascolteranno le prove nelle prossime tre settimane.

Le arringhe d’apertura sono fissate per oggi, 28 aprile. Da quel momento, e fino a metà maggio, OpenAI dovrà difendere la propria esistenza. E a fare da sfondo, va detto, c’è la quotazione in borsa attesa per il quarto trimestre 2026, valutata diversi trilioni di dollari.

Il caso Musk-Altman, le accuse dimezzate

Quello che arriva in aula non è la causa che Musk aveva depositato nel 2024, adesso è decisamente più ridotta.

Venerdì 24 aprile Musk ha ritirato di sua iniziativa le accuse di frode e “frode costruttiva” contro Altman. Ufficialmente per “snellire” il dibattimento, ma il risultato concreto è che davanti alla giuria restano solo due capi d’accusa di natura equitativa: violazione del vincolo di destinazione non profit e arricchimento ingiustificato.

La giuria in questa occasione ha potere solo consultivo. Infatti, sarà la giudice Gonzalez Rogers a emettere la decisione vincolante, in una seconda fase del processo che inizierà il 18 maggio davanti, appunto, alla sola giudice. Questo significa che i titoli che leggeremo nei prossimi giorni, “Musk vince” o “Altman vince”, andranno presi con estrema cautela. La partita vera si gioca dopo, lontano dai giurati.

Il percorso di pulizia dei capi d’accusa è cominciato da tempo. La causa originaria, depositata presso la corte federale ad agosto 2024, conteneva ben 26 capi d’accusa. Tra questi c’erano l’associazione a delinquere ai sensi del RICO, le violazioni delle norme antitrust dello Sherman Act, la pubblicità ingannevole. Tutte decadute.

RICO sta per Racketeer Influenced and Corrupt Organizations Act, una legge federale americana del 1970. Nata per colpire la mafia italoamericana, quando i procuratori non riuscivano a incastrare i boss perché i singoli reati venivano commessi dai sottoposti.

In questo contesto, Musk sosteneva che OpenAI, Altman, Microsoft e altri avessero costruito uno schema fraudolento sistematico per appropriarsi degli asset della nonprofit, e che quindi rientrassero nella definizione di organizzazione corrotta secondo il RICO.

Nel corso dei mesi dalla deposizione, la giudice Gonzalez Rogers ha provveduto ad attivare un esame attento dei capi d’accusa. Il processo che verrà celebrato è un guscio di quello che Musk aveva immaginato. Resta però la richiesta più ambiziosa, quella sui risarcimenti miliardari e qui le cifre sono esorbitanti.

Le richieste di Elon Musk

Il 7 aprile scorso Musk ha depositato la sua richiesta formale di risarcimenti per la seconda fase. Vuole la rimozione di Altman da amministratore delegato e da direttore della Foundation. Chiede la rimozione di Greg Brockman da presidente della società di pubblico beneficio. E vuole l’annullamento della conversione del 28 ottobre 2025 che ha trasformato OpenAI in società a scopo di lucro.

Inoltre, vuole una restituzione che potrebbe arrivare a circa 134 miliardi di dollari.

Va specificato che questa somma non finirebbe nelle tasche di Musk. Andrebbe alla OpenAI Foundation, l’ente di beneficenza che oggi controlla il 26% della società. Musk, in altre parole, ha strutturato la sua causa in modo da non incassare nulla personalmente. Il suo guadagno finanziario di fronte ad una eventuale una vittoria sarebbe zero.

È un punto che al momento sta sfuggendo ai più, ma che vale la pena evidenziare. Quello che in sostanza chiede Musk è la rimozione di Sam Altman e di Greg Brockman dai loro incarichi.

La difesa di OpenAI e la benedizione dei due procuratori

Nonostante la causa, il 28 ottobre 2025 OpenAI ha completato la sua ristrutturazione societaria. OpenAI, Inc. è diventata la OpenAI Foundation, un ente nonprofit. Il braccio operativo è diventato OpenAI Group PBC, una società di pubblico beneficio del Delaware. La fondazione detiene il 26% della nuova entità, circa 130 miliardi di dollari di valore. Microsoft detiene il 27%, circa 135 miliardi.

Ora, sia il procuratore generale californiano Bonta sia quello del Delaware Jennings hanno emesso dichiarazioni di non obiezione sulla ristrutturazione, dopo aver ottenuto da OpenAI concessioni che assicurano che gli asset rimangano “irrevocabilmente dedicati a scopi di beneficenza”. E qui si entra nel cuore della questione giuridica.

Negli Stati Uniti, i procuratori generali statali sono i custodi pubblici degli enti di beneficenza. Sono loro, in via primaria, a dover vigilare che un ente fondato per scopi benefici rispetti le sue promesse. Se i due procuratori generali competenti hanno esaminato le carte e non hanno sollevato obiezioni, la pretesa di Musk secondo cui OpenAI avrebbe violato proprio quel vincolo di destinazione benefica entra in tribunale già molto azzoppata. Ma su questo si vedrà a fine processo.

Da una parte, Musk e il suo team punteranno tutto sulle prove documentali interne. Dall’altra, OpenAI risponderà agitando la firma dei due procuratori generali e l’approvazione formale dello Stato della California. La giuria dovrà decidere a quale autorità prestare fede. E la giudice ha già definito “un testa o croce” il merito della questione, quando a marzo 2025 ha respinto l’ingiunzione preliminare richiesta da Musk. Si tratta di un pronunciamento che non sbilancia la giudice verso nessuna delle parti in causa.

Un passo indietro al 2015, quando nacque OpenAI

OpenAI nasce l’11 dicembre 2015 come ente nonprofit del Delaware. La missione dichiarata è ambiziosa, persino ingenua per i tempi che sarebbero venuti dopo: avanzare l’intelligenza digitale “nel modo più probabile per beneficiare l’umanità”, senza il vincolo del profitto.

I co-presidenti sono Sam Altman, allora a capo di Y Combinator, ed Elon Musk. Il direttore tecnico è Greg Brockman, il direttore scientifico Ilya Sutskever.

L’annuncio si regge su una promessa di finanziamento da un miliardo di dollari, sottoscritta da Musk, Altman, Brockman, Reid Hoffman, Peter Thiel, Jessica Livingston, AWS, Infosys e YC Research. Solo che, come emergerà anni dopo, di quel miliardo entro il 2021 era stato effettivamente versato qualcosa come 133 milioni.

E la quota di Musk, oggetto di contestazione che attraversa tutto il processo, è inferiore a 45 milioni di dollari secondo la contabilità di OpenAI. Una ricostruzione di Semafor del marzo 2023 parlava di 100 milioni da fonti anonime, ma i documenti evidenziano la cifra più bassa.

Lo scarto tra impegni annunciati e denaro effettivamente messo a disposizione non è un dettaglio. È parte di come Musk costruisce oggi la sua tesi del “patto fondativo”.

La rottura del 2018 e la versione di Musk

Musk lascia il consiglio di OpenAI il 20 febbraio 2018. La versione che fornisce allora ai dipendenti è quella del conflitto di interessi: Tesla sta correndo verso l’intelligenza artificiale per la guida autonoma, e quindi non si può più stare in due posti contemporaneamente.

È una versione plausibile, accettabile, ben struttturata. Solo che, come ha rivelato per primo Semafor cinque anni dopo e come hanno poi confermato le email pubblicate da OpenAI nel marzo 2024, non risulta essere la versione completa.

A fine 2017, Musk aveva detto ad Altman che OpenAI era “rimasta fatalmente indietro rispetto a Google”. E aveva proposto di prenderne la guida lui stesso, come amministratore delegato, con la maggioranza delle quote e il pieno controllo del consiglio. In alternativa, di fondere OpenAI dentro Tesla. Brockman, Sutskever e Altman rifiutarono questa proposto. E Mus di conseguenza se ne andò.

Il 15 settembre 2017, prima ancora di rompere con Altman, Musk aveva fatto incorporare in silenzio una società del Delaware chiamata Open Artificial Intelligence Technologies, Inc., attraverso il suo fiduciario personale Jared Birchall.

Una società già strutturata come società di pubblico beneficio, esattamente la stessa forma giuridica che Musk oggi accusa OpenAI di aver scelto per tradire la missione. La trovata la racconta OpenAI nel suo blog ufficiale, e i giudici l’hanno ammessa come prova al processo.

In una mail del 1° febbraio 2018, Musk inoltrò una proposta secondo cui OpenAI avrebbe dovuto “agganciarsi a Tesla come sua mucca da mungere”, scrivendo che era “esattamente giusto”. Quando lasciò, disse allo staff che la “probabilità di successo” di OpenAI era zero, e ritirò la quota residua del suo impegno. Il discorso sul conflitto Tesla, secondo Semafor, “non fu accolto bene. La maggior parte non si bevve completamente la storia”.

Una cosa è raccontare di essersene andati per principio. Un’altra è essersene andati dopo aver provato a prendersi tutto. Il processo che si è aperto ieri cercherà di stabilire quale delle due versioni risulterà essere quella vera.

L’accelerazione di OpenAI e il ruolo di Microsoft

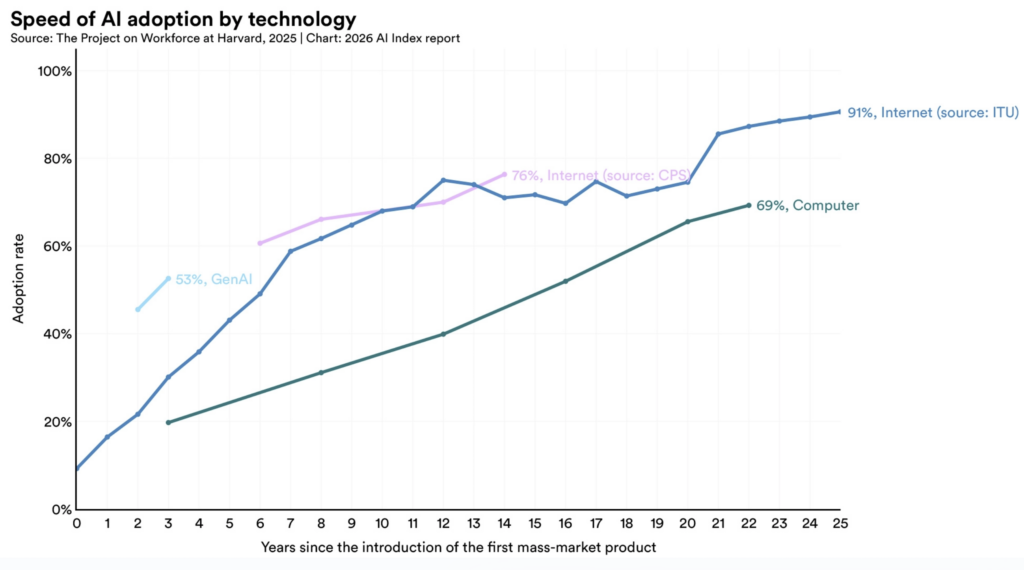

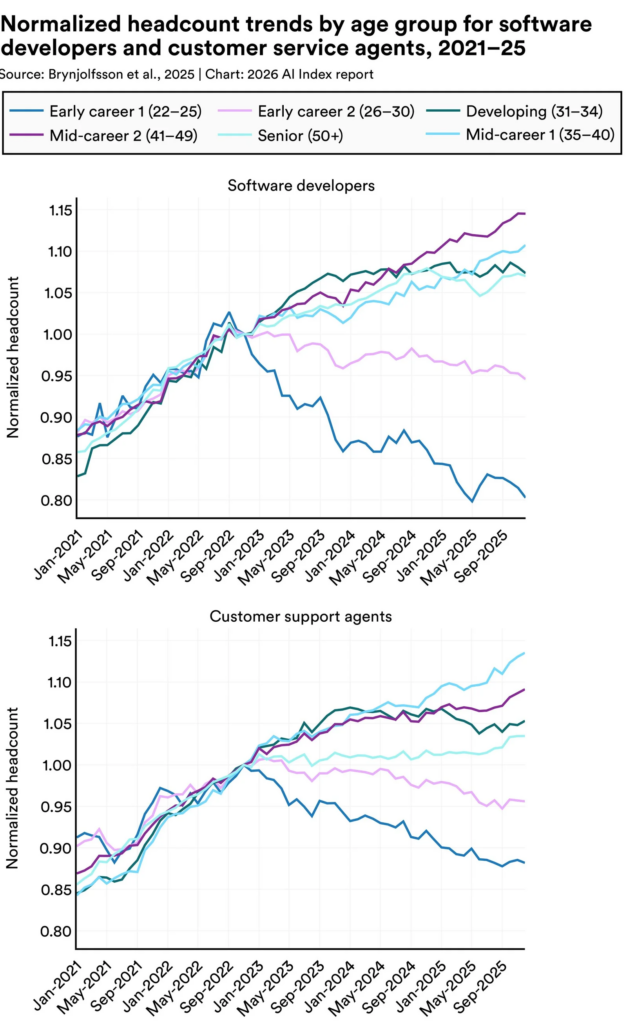

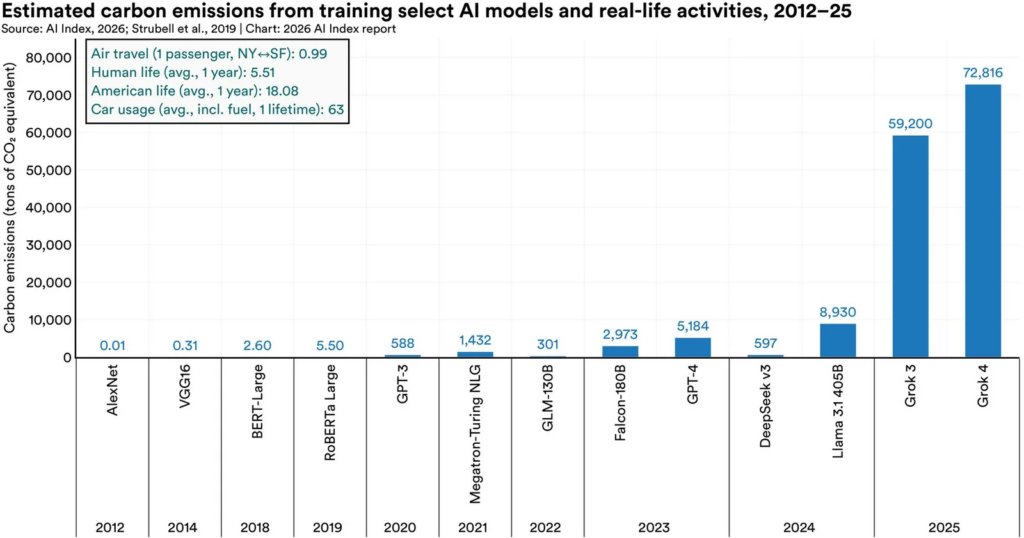

Il 30 novembre 2022, OpenAI lancia ChatGPT. Nel giro di cinque giorni il chatbot raggiunge un milione di utenti e a gennaio 2023 sono già 100 milioni gli utenti attivi mensili, l’adozione consumer più veloce della storia. La valutazione di OpenAI esplode. Da circa 14 miliardi di dollari nel 2021 si passa a 29 miliardi a gennaio 2023, a 86 miliardi a fine dello stesso anno, fino agli oltre 850 miliardi di oggi.

In quel passaggio, Microsoft consolida la sua presenza con un investimento da circa 10 miliardi di dollari, che porta il totale dei suoi versamenti vicino ai 13 miliardi. Una struttura societaria complessa le riconosce il 75% dei profitti fino al recupero del capitale, poi il 49% fino a un tetto di circa 92 miliardi.

Una struttura che, secondo Musk, consolida quello che lui stesso definisce un cartello tra OpenAI, Microsoft e l’industria del cloud. Il giudice però ha respinto in via definitiva questa tesi: l’accusa antitrust è caduta, e i due dirigenti che la rendevano possibile, Reid Hoffman e Deannah Templeton, si sono dimessi prima che la causa arrivasse in aula.

Resta in piedi solo un capo di accusa contro Microsoft, ossia quello di concorso nella violazione del vincolo di destinazione non profit. Per questo Microsoft ha solo cinque ore di tempo davanti alla giuria, contro le venti riservate a Musk e a OpenAI.

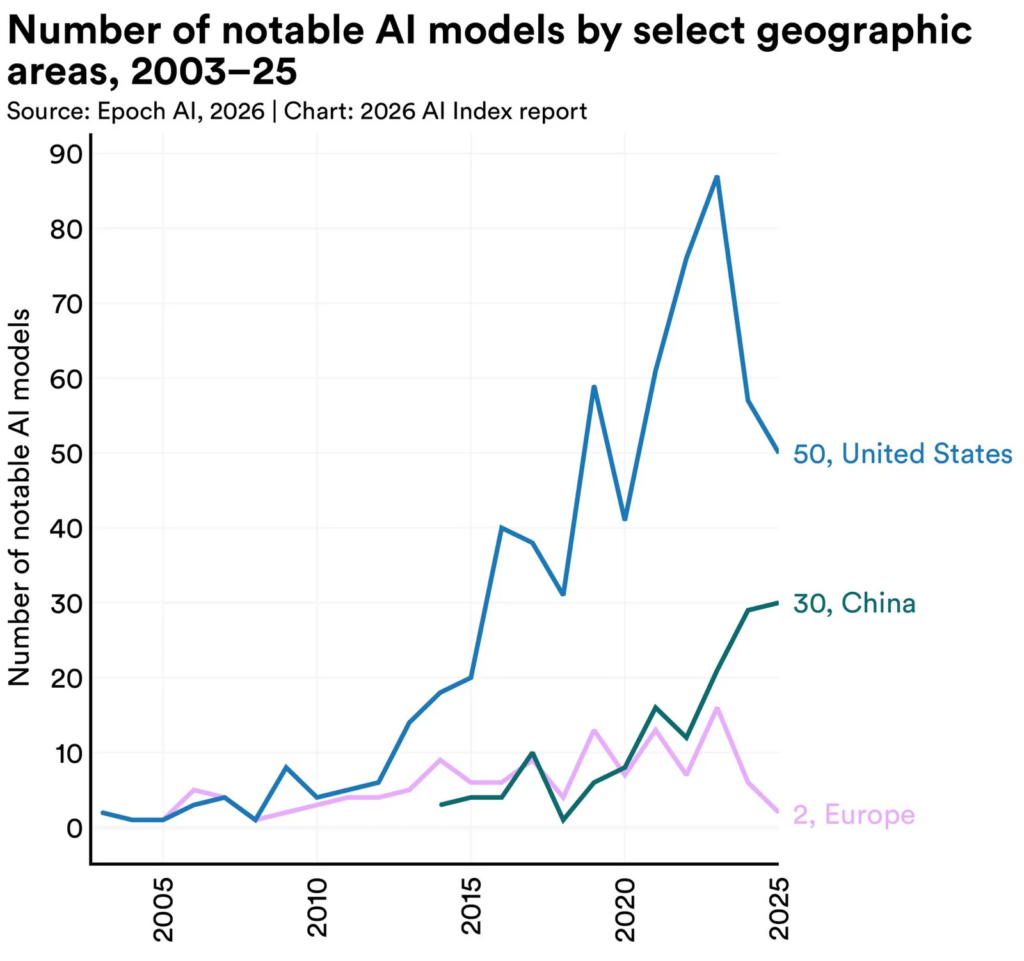

Per contrastare OpenAI, Musk fonda xAI

Il 9 marzo 2023, mentre ChatGPT porta nel mondo la sua IA generativa, Musk fonda silenziosamente X.AI Corp. in Nevada. La presenta pubblicamente il 12 luglio 2023 dagli studi di Tucker Carlson, descrivendola come “TruthGPT”, un’alternativa a ChatGPT che secondo lui sarebbe “addestrato a essere politicamente corretto”. Il chatbot, ribattezzato Grok, viene lanciato su X il 4 novembre 2023.

A marzo 2025, la fusione tra xAI e X porta il valore complessivo del veicolo intorno ai 113 miliardi. A febbraio 2026, SpaceX assorbe xAI in un’operazione tutta in azioni a una valutazione combinata di circa 1,25 trilioni di dollari.

Tutto questo costruisce un contesto che offre ad OpenAI un argomento forte da portare in questo processo: Musk non sta combattendo solo per dei principi, sta combattendo anche per un’azienda concorrente che brucia un miliardo di dollari al mese e che ha bisogno di bloccare proprio OpenAI per poter crescere.

Le risposte giudiziarie di OpenAI, depositate il 9 aprile 2025, inquadrano esplicitamente la causa di Musk come una campagna integrata di molestie a beneficio di xAI: la campagna social “Scam Altman”, l’offerta-fantoccio da 97,4 miliardi del febbraio 2025, l’uso strumentale del contenzioso. Tutto, secondo OpenAI, andrebbe letto come uno strumento di competizione.

Cosa rischia davvero ciascuno dei protagonisti

Arrivati a questo punto, dopo aver cercato – si spera bene – di ricostruire il percorso che ha portato fino a oggi, possiamo provare a capire cosa concretamente è in gioco per ciascuno dei protagonisti.

Per Sam Altman, il rischio è il ruolo di CEO di OpenAI

Per Altman, il rischio diretto passa dalla richiesta di Musk di rimuoverlo da amministratore delegato di OpenAI e da direttore della Foundation, oltre alla restituzione delle sue quote.

Se la giudice Gonzalez Rogers decidesse di prendere o meno in considerazione questa strada è una questione tutta da vedere, perché OpenAI sostiene che non è al momento una procedura prevedibile. Va specificato, peraltro, che nessun rinvio penale è stato pubblicamente riportato contro Altman. I capi di accusa di frode sono stati ritirati dallo stesso Musk venerdì scorso.

Il rischio reputazionale, però, è molto più evidente. In fase di processo emergerà sicuramente un messaggio del 2017 in cui Altman scriveva a Musk “resto entusiasta della struttura nonprofit!”, in un momento in cui le discussioni interne avevano già imboccato la strada del for profit.

E farà emergere il diario personale di Brockman del 2017, in cui il direttore tecnico ammetteva che “sarebbe sbagliato rubare la non-profit” a Musk. Il consiglio di OpenAI, presieduto da Bret Taylor, appare per ora solido, ma le testimonianze potrebbero giocare un certo peso all’interno del CdA.

Per Elon Musk, il rischio è la sua credibilità

Il rischio finanziario diretto di Musk, come abbiamo già visto, è teoricamente pari a zero, perché qualunque tipo di risarcimento finirebbe alla Foundation e non a lui.

Ma i contro-ricorsi di OpenAI per la seconda fase chiedono danni compensativi non quantificati e un’ingiunzione che impedisca ulteriori interferenze. E c’è un punto, soprattutto, su cui OpenAI ha intenzione di insistere. Ed è quello delle email del 2017 e del 2018 in cui Musk contemplava una fusione con Tesla, e l’incorporazione segreta della società del Delaware del settembre 2017. Si tratta, secondo OpenAI, di email che contraddicono direttamente la narrazione che lui stesso porta in tribunale. La sua credibilità è quindi davvero a rischio.

Va aggiunto che Musk ha altri fronti aperti contemporaneamente. La causa SEC sulla mancata comunicazione delle quote in Twitter è in attesa di processo dopo il rigetto della richiesta di archiviazione del 3 febbraio scorso.

E nel caso Pampena, una giuria ha già stabilito il 20 marzo 2026 che Musk fece dichiarazioni false agli azionisti di Twitter, con danni potenzialmente fino a 2,6 miliardi di dollari ancora pendenti. Una sconfitta in tribunale a Oakland, anche solo davanti ad una giuria consultiva, andrebbe a sommarsi a un quadro già complicato.

Per OpenAI, il rischio è strutturale e tocca la quotazione in borsa

La minaccia più grande per OpenAI come organizzazione è la richiesta di annullare la conversione del 28 ottobre 2025. Significherebbe smontare l’intera architettura societaria che oggi vale più di 850 miliardi di dollari.

La salita, lo abbiamo detto, è ripida per via della benedizione dei due procuratori generali, ma non è impossibile. E in mezzo c’è un altro elemento concreto, di cui si parla poco: OpenAI ha esplicitamente segnalato la causa Musk come fattore di rischio nella documentazione distribuita agli investitori in vista della quotazione in borsa attesa per il quarto trimestre 2026.

Sull’altro versante, OpenAI sta effettivamente guadagnando terreno anche nel governo federale. Il contratto del Pentagono da 200 milioni di dollari, assegnato a giugno 2025, vale fino a luglio 2026. E il 27 febbraio scorso, l’amministrazione Trump ha messo al bando Anthropic a livello federale, dopo che la rivale aveva rifiutato casi d’uso legati ad armi autonome e sorveglianza di massa, e ha annunciato un nuovo accordo con OpenAI. Un quadro che, sul piano commerciale, va in direzione opposta a quella che Musk vorrebbe.

In gioco è anche il futuro della IA

La sentenza che il giudice Gonzalez Rogers emetterà verso la metà maggio non risolverà solo il duello tra Musk e Altman. Ma stabilirà un precedente sul fatto che entità fondate come non-profit possano poi convertirsi in società di lucro onorando, almeno formalmente, l’originario vincolo benefico.

Quello stesso modello regge oggi anche Anthropic, che è nata fin dall’origine come società a scopo di lucro ed è oggi valutata intorno ai 350 miliardi di dollari. E sarebbe il modello a cui si guarderanno tutti i laboratori di intelligenza artificiale che dovessero seguire la stessa strada. Una vittoria di Musk congelerebbe l’architettura; una sconfitta, al contrario, validerebbe il modello e libererebbe la strada per la quotazione in borsa di OpenAI e per ristrutturazioni simili in tutta la Silicon Valley.

E sullo sfondo c’è Stargate, il progetto infrastrutturale da 500 miliardi di dollari su quattro anni, annunciato il 21 gennaio 2025 con Trump, Altman, Larry Ellison e Masayoshi Son. Al momento in forte ritardo, ma resta la cornice politica di un progetto che dovrebbe ridisegnare l’infrastruttura americana dell’intelligenza artificiale. Un verdetto contro OpenAI complicherebbe anche questo disegno.

Cosa osservare nelle prossime tre settimane

La prima fase del processo, quella davanti alla giuria consultiva, dovrebbe concludersi entro metà maggio. Le venti ore a disposizione di ciascuna parte voleranno via e poi ci sono i testimoni. Musk, Altman, Brockman; e poi Satya Nadella, l’amministratore delegato di Microsoft, che testimonierà per la difesa; Ilya Sutskever, il co-fondatore che ha votato per rimuovere Altman nel 2023; Mira Murati, l’ex direttrice tecnica di OpenAI che oggi guida Thinking Machines; Helen Toner, l’altra ex consigliera che a novembre 2023 fece parte del consiglio che destituì Altman per cinque giorni; Shivon Zilis, madre di quattro dei figli di Musk.

Tre cose, in particolare, vale la pena guardare. La prima è come Brockman gestirà al controesame il proprio diario del 2017. Quel diario, che parla della struttura nonprofit come di “una bugia”, è la prova più pesante che Musk porta in aula.

La seconda è come verrà letto il messaggio “sei il mio eroe” che Altman mandò a Musk nel febbraio 2023, ammesso come prova ma soggetto a interpretazioni opposte.

La terza, e forse la più importante, è se la testimonianza di Nadella confermerà o no l’allineamento tra Microsoft e OpenAI. Perché il giorno dopo il verdetto della giuria, sia esso favorevole o meno a Musk, è da quell’allineamento che dipende il futuro di OpenAI.

Il 18 maggio, finita la prima fase, la giudice Gonzalez Rogers aprirà la seconda, ossia quella senza giuria e che sarà quella vincolante. Sarà in quel momento, e non davanti ai nove giurati, che si deciderà se OpenAI uscirà da questo processo intatta, ridimensionata o smembrata.

Per concludere questo percorso di ricostruzione di questa vicenda del caso Musk contro Altman, sperando di essere riuscito nell’intento di rendere tutto più chiaro, non resta che seguire le varie fasi per osservare se ci saranno colpi di scena.

Il verdetto della prima fase, come già ricordato, è atteso a metà maggio, mentre quello vincolante, qualche settimana dopo. Vedremo davvero cosa succederà.