Meta ha presentato Muse Spark, il primo modello di IA sviluppato dal nuovo Superintelligence Lab. È un modello proprietario che segna una rottura netta con la filosofia open source che aveva caratterizzato Meta fino a ieri. La domanda è se tutto questo basterà a colmare il divario con OpenAI, Anthropic e Google.

Mark Zuckerberg ha al momento diversi problemi, ma uno in particolare ce l’ha con le promesse. Nel gennaio 2025 aveva annunciato che sarebbe stato un anno decisivo per l’intelligenza artificiale di Meta, con Llama 4 pronto a diventare il modello stato dell’arte e Meta AI destinata a raggiungere un miliardo di utenti.

Un anno dopo, Llama 4 è soltanto un ricordo imbarazzante, il Chief AI Scientist che lo aveva costruito se n’è andato sbattendo la porta, e Zuckerberg si ritrova a presentare qualcosa di completamente diverso.

Ma questa volta la posta in gioco è diversa. Non si tratta di un aggiornamento incrementale o di una nuova versione di un prodotto esistente.

Muse Spark rappresenta una rottura totale con il passato di Meta. È un modello proprietario invece che open source ed è stato costruito da un team quasi interamente nuovo.

Muse Spark rappresenta il prodotto concreto di una riorganizzazione che ha investito ogni livello dell’azienda. Centinaia di licenziamenti, l’abbandono progressivo del metaverso, investimenti da 135 miliardi di dollari nel solo 2026. E al centro di tutto, un ventottenne che fino a ieri guidava un’azienda di etichettatura dati. Ma andiamo con ordine.

Muse Spark nasce dalle ceneri di Llama

Per capire Muse Spark bisogna partire da quello che è successo prima.

Nell’aprile 2025, Meta lancia Llama 4 nelle varianti Maverick e Scout, ma il rilascio è un disastro. Yann LeCun, premio Turing 2019 e Chief AI Scientist di Meta dal 2013, ammetterà poi al Financial Times che i risultati erano stati falsificati: il team aveva usato versioni ottimizzate per specifici benchmark, gonfiando artificialmente le prestazioni. Il modello di punta, Behemoth, viene rinviato più volte e infine accantonato.

Zuckerberg, furioso, mette da parte l’intera organizzazione GenAI e inizia a reclutare personalmente un nuovo team.

Crea un gruppo WhatsApp chiamato Recruiting Party attivo 24 ore su 24. Il risultato di quella crisi è Muse Spark, nome in codice interno Avocado, costruito da zero in nove mesi dal nuovo Meta Superintelligence Labs. Non è una versione evoluta di Llama, è un modello completamente diverso, ricostruito a partire da un nuovo stack di pre-training.

Cosa fa Muse Spark

Proviamo a spiegarlo in modo semplice, perché è importante capire di cosa stiamo parlando.

Muse Spark è un modello di intelligenza artificiale multimodale, il che significa che può elaborare testo, immagini e voce contemporaneamente.

Ha una finestra di contesto di 262.000 token, vale a dire che può tenere a mente una quantità enorme di informazioni durante una conversazione. E opera in tre modalità diverse a seconda di cosa gli viene chiesto.

La modalità Instant serve per le domande rapide: chiedi qualcosa, ottieni una risposta immediata. La modalità Thinking attiva un ragionamento più profondo per problemi complessi. Ma la vera novità è la modalità Contemplating, che orchestra più sotto-agenti che ragionano in parallelo.

In pratica, se chiedi a Meta AI di pianificare un viaggio in famiglia, un agente si occupa dell’itinerario, un altro confronta le destinazioni, un terzo cerca le attività adatte ai bambini. Tutto contemporaneamente.

Tra le capacità distintive c’è il ragionamento visivo: si può fotografare uno scaffale di snack in aeroporto, ad esempio, e Muse Spark ti dice quali hanno più proteine senza che tu debba leggere le etichette.

C’è poi una modalità shopping che integra dati comportamentali dalle piattaforme Meta. E ci sono capacità di ragionamento medico sviluppate in collaborazione con oltre mille medici, anche se su questo punto, va detto, i dubbi sulla privacy restano aperti.

Muse Spark, una storia all’inseguimento

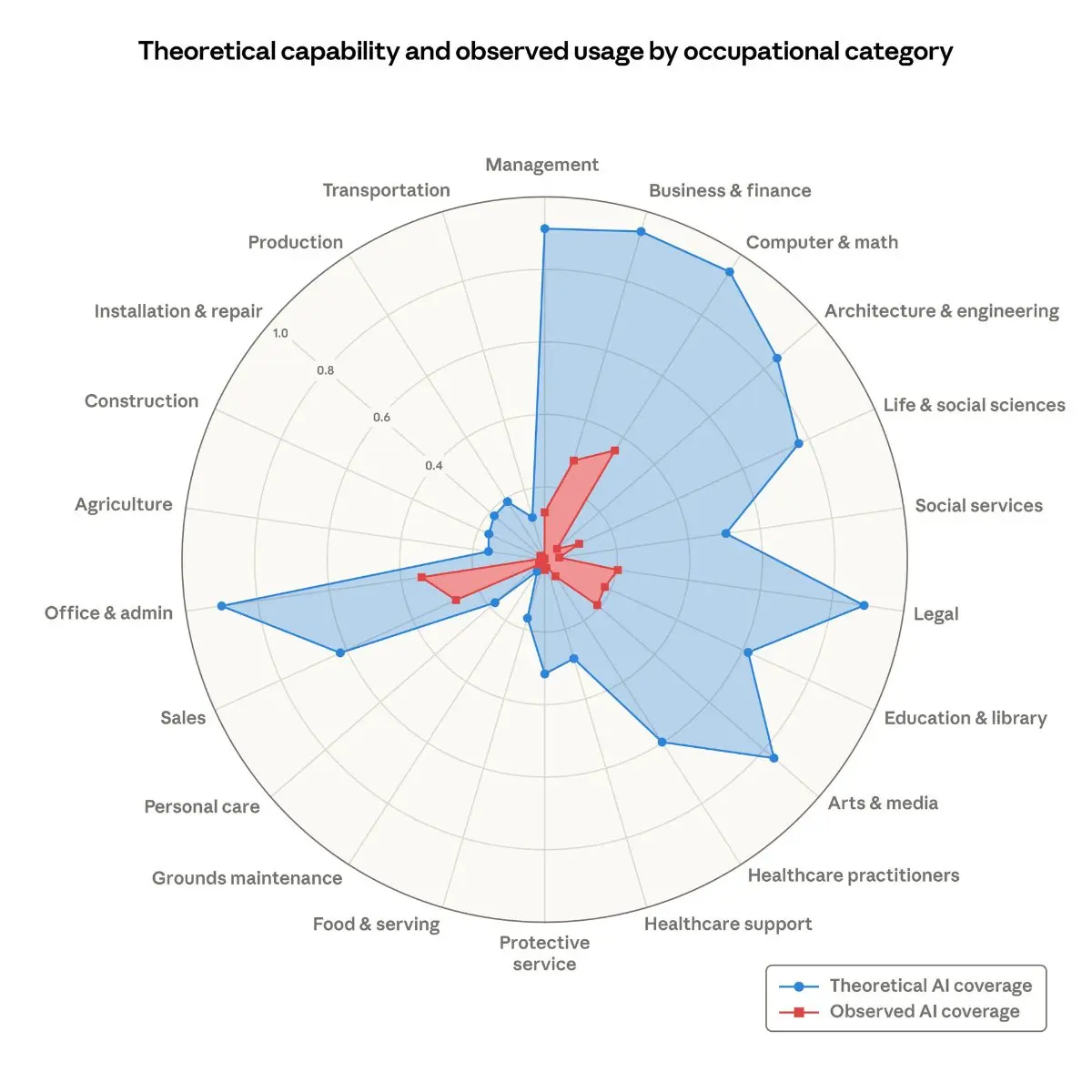

I benchmark sono il modo in cui l’industria misura le capacità dei modelli di IA, e quelli di Muse Spark raccontano dei dati interessanti.

Sull’Artificial Analysis Intelligence Index, il modello di Meta ottiene un punteggio di 52, collocandosi nella top 5 globale ma dietro a GPT-5.4 e Gemini 3.1 Pro, entrambi a 57, e leggermente sotto Claude Opus 4.6, a 53. Il salto rispetto ai modelli Llama 4 è enorme: Maverick aveva ottenuto 18, Scout appena 13.

Dove Muse Spark eccelle davvero è nei benchmark specialistici.

Nel ragionamento medico batte GPT-5.4 e surclassa tutti gli altri. Nella comprensione di grafici e figure supera anche i migliori modelli di OpenAI. Ma i punti deboli sono altrettanto significativi: nel ragionamento astratto il divario con Gemini è drastico, 42.5 contro 76.5. E nel coding agentico, che è diventato l’obiettivo principale di Anthropic e degli altri nella corsa all’IA, GPT-5.4 lo supera nettamente.

C’è poi un aspetto che va sottolineato, perché riguarda la credibilità di questi numeri.

I benchmark auto-dichiarati di Meta vanno trattati con cautela data la storia recente.

Fortune ha notato che le verifiche indipendenti mostrano a volte discrepanze: su alcuni test, Meta dichiara risultati che i laboratori esterni non riescono a replicare. È un problema di fiducia che l’azienda dovrà risolvere.

L’abbandono dell’open source e la svolta strategica

La scelta closed source è il cambio di rotta più clamoroso.

Nel luglio 2024, Zuckerberg aveva pubblicato un manifesto intitolato Open Source AI is the Path Forward, paragonando Llama a Linux e argomentando che l’IA open source rappresentava la migliore possibilità del mondo di sfruttare questa tecnologia. Appena due anni dopo, Muse Spark è completamente un modello proprietario.

Le ragioni di questa inversione sono diverse.

Primo, la pressione competitiva: dopo il fallimento di Llama 4, Meta non può permettersi di regalare le proprie innovazioni ai concorrenti.

Secondo, il precedente di DeepSeek: il laboratorio cinese aveva copiato con successo l’architettura di Llama per sviluppare il proprio modello R1, dimostrando concretamente i rischi della strategia aperta.

Terzo, la monetizzazione: Meta sta sperimentando l’accesso API a pagamento, attualmente in anteprima privata per partner selezionati.

La strategia emergente sembra quella di un modello freemium: i modelli più potenti e recenti restano proprietari e disponibili tramite API a pagamento, mentre le versioni precedenti vengono rilasciate come open source. Meta ha dichiarato di sperare di rendere open source le future versioni del modello, ma senza fornire alcuna tempistica. Tradotto: per ora resta tutto chiuso.

Alexandr Wang e i 14 miliardi di dollari per un ventottenne

A guidare il Meta Superintelligence Labs c’è Alexandr Wang, nominato primo Chief AI Officer nella storia di Meta. La sua storia merita di essere raccontata perché dice molto sulla scommessa che Zuckerberg sta facendo.

Nato nel 1997 a Los Alamos, figlio di fisici cinesi immigrati che lavoravano al laboratorio nazionale, Wang aveva fondato Scale AI a 19 anni abbandonando il MIT. A 24 anni era il più giovane miliardario self-made al mondo.

Meta ha investito 14,3 miliardi di dollari per una quota del 49% in Scale AI, raddoppiandone la valutazione. Come parte dell’accordo, Wang ha lasciato la carica di CEO per guidare il nuovo laboratorio. Zuckerberg lo ha descritto come il fondatore più impressionante della sua generazione. Ma c’è chi solleva dubbi: Wang viene da un’azienda di etichettatura dati, non dalla ricerca fondamentale sull’IA.

E il suo arrivo ha provocato la partenza di Yann LeCun, che al Financial Times ha dichiarato di non essere disposto a sottostare all’autorità di un giovane e inesperto manager.

I licenziamenti e l’abbandono del metaverso

La nascita del Superintelligence Labs è solo un tassello di una riorganizzazione che ha investito ogni livello di Meta. L’elenco delle perdite è impressionante.

Yann LeCun se n’è andato e ha fondato un proprio laboratorio raccogliendo oltre un miliardo di dollari.

Chris Cox, Chief Product Officer e veterano ventennale, è stato rimosso dalla supervisione dell’IA dopo il fiasco di Llama 4. Undici dei quattordici ricercatori originali che avevano costruito il primo modello Llama nel 2023 hanno lasciato l’azienda.

I licenziamenti hanno riguardato circa 600 posizioni del laboratorio, nell’ottobre 2025; circa 1.500 dipendenti da Reality Labs nel gennaio 2026 con la chiusura degli studi di gioco VR, e diverse centinaia in più nel marzo 2026.

Come avevo raccontato qui su InTime Blog analizzando l’acquisizione di Moltbook, Meta sta ridisegnando completamente la propria struttura organizzativa attorno all’intelligenza artificiale.

Il ridimensionamento del metaverso è stato altrettanto drastico.

Reality Labs ha accumulato oltre 70 miliardi di dollari di perdite operative dal 2021. Bloomberg ha riportato che Meta stava tagliando la spesa per il metaverso fino al 30%.

La ristrutturazione ha colpito anche Horizon Worlds, il mondo virtuale che Zuckerberg aveva immaginato per un miliardo di persone. Verrà rimosso dalla VR il 15 giugno 2026, sopravvivendo solo come esperienza mobile.

Era il progetto per cui Facebook aveva cambiato nome in Meta.

Zuckerberg e la superintelligenza personale per tutti

Nel luglio 2025, Zuckerberg ha pubblicato un lungo post intitolato Personal Superintelligence for Everyone, in cui delineava la sua visione.

Vale la pena di soffermarsi su cosa intende, perché è diverso da quello che propongono i concorrenti.

La superintelligenza personale di Meta non è un sistema centralizzato che automatizza tutto il lavoro umano. Si tratta di un compagno personale che ci conosce profondamente, comprende i nostri obiettivi, e può aiutarci a raggiungerli.

Come avevo scritto sulla strategia di Meta verso la superintelligenza, questa visione ha un vantaggio strutturale che nessun concorrente può ancora raggiungere. E cioè 3,58 miliardi di utenti giornalieri sulle piattaforme Meta.

Se Muse Spark funziona, quella distribuzione potrebbe trasformarlo nel modello di IA più utilizzato al mondo quasi per inerzia.

È la stessa logica che ha guidato l’acquisizione di Moltbook, il social network per agenti AI: Meta sta costruendo l’infrastruttura dove l’intelligenza artificiale vive, lavora e interagisce.

Lo scenario competitivo e la frattura Altman-Amodei

Muse Spark arriva in un panorama competitivo incandescente.

Il giorno prima del lancio, Anthropic ha svelato Claude Mythos Preview, descritto come il modello di IA più potente mai sviluppato dall’azienda, talmente pericoloso da non poter essere rilasciato al pubblico per le minacce alla sicurezza informatica.

È disponibile solo per dodici partner selezionati, tra cui AWS, Apple, Google e Microsoft. Come avevo analizzato qui su InTime Blog raccontando la frattura tra Altman e Amodei, la rivalità tra i due è ormai una guerra aperta.

C’è poi il rapporto con Elon Musk, che ha seguito una traiettoria inversa: dalla sfida alla gabbia del 2023 a un disgelo tattico.

Come avevo scritto nell’articolo sulla possibile alleanza tra Zuckerberg e Musk, documenti giudiziari desecretati nel marzo 2026 hanno rivelato contatti diretti tra i due.

Insomma, non si tratta solo del lancio di un nuovo modello di IA, come ormai ci stiamo abituando ad assistere praticamente ogni giorno.

Dietro c’è una strategia che val la pena di essere indagata per capire il perché di certe mosse, per avere chiaro anche il contesto in cui ci si muove.

E anche di comprendere come lo schema delle alleanze si muove e agisce di conesguenza.