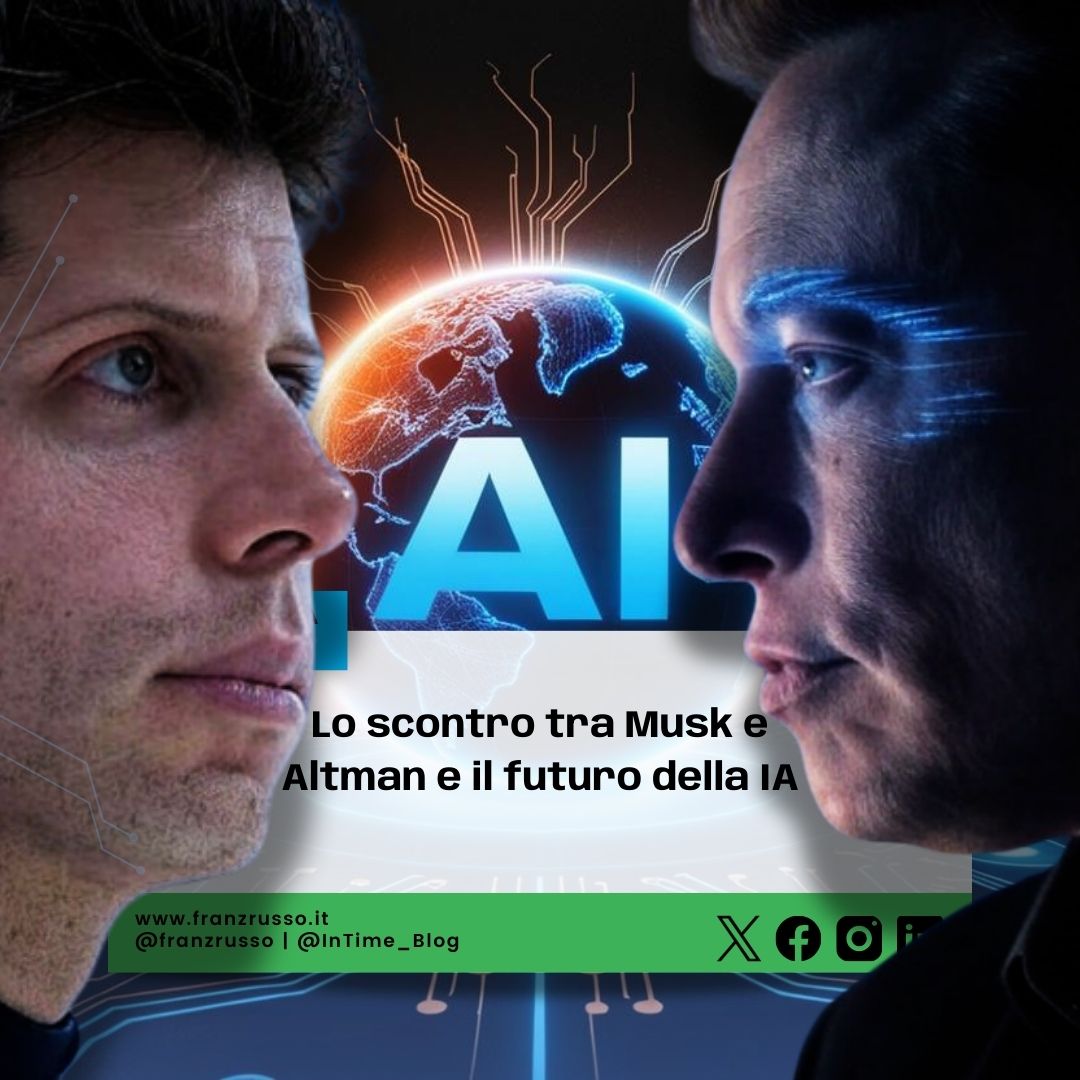

Elon Musk tenta di acquisire OpenAI con un’offerta ostile da 97,4 mld$, ma Sam Altman la rifiuta nettamente. Tra rivalità, cause legali e strategie, lo scontro diretto tra i due è destinato a peggiorare. In mezzo c’è il controllo della IA.

Quando ieri, 10 febbraio 2025, in Italia era serata inoltrata è arrivata l’ennesima mossa di Elon Musk. A scriverne per primo è stato il Wall Street Journal.

Il miliardario ha annunciato un’offerta ostile da 97,4 miliardi di dollari per acquisire la società no-profit che controlla OpenAI.

Una mossa che arriva in un contesto già molto teso e che, in realtà, ha radici profonde nella rivalità tra Musk e Sam Altman, attuale CEO di OpenAI.

Ma facciamo un passo indietro per capire meglio cosa sta succedendo.

Il progetto AI di Trump senza Musk

Lo scorso 21 gennaio 2025, il presidente degli Stati Uniti Donald Trump ha annunciato il progetto “Stargate”, un’iniziativa da 500 miliardi di dollari per lo sviluppo di infrastrutture dedicate all’intelligenza artificiale. Il progetto vede la partecipazione di OpenAI, SoftBank, Oracle e altre grandi realtà tecnologiche, con l’obiettivo di costruire una rete di data center avanzati che sosterranno lo sviluppo dell’IA nei prossimi anni.

La conferenza alla Casa Bianca ha visto protagonisti Sam Altman, Larry Ellison e Masayoshi Son, ma Elon Musk non era presente. Un’assenza che ha fatto molto discutere, considerando il ruolo che Musk ha oggi e che avuto in passato nella creazione di OpenAI.

Secondo diverse fonti, questa esclusione sarebbe stata percepita come un affronto dal CEO di Tesla e SpaceX, spingendolo a rispondere con un’offerta ostile per acquisire il controllo di OpenAI.

L’offerta ostile e la risposta tagliente di Sam Altman

Elon Musk ha quindi deciso di tentare un vero colpo di mano con un’offerta da 97,4 miliardi di dollari per acquisire il controllo della no-profit OpenAI Inc., che sovrintende l’azienda a scopo di lucro OpenAI LP.

La proposta è stata rapidamente respinta da Sam Altman, che ha risposto su X (ex Twitter) con una provocazione:

“No grazie, se vuoi compriamo Twitter a 9,74 miliardi di dollari.”

Un chiaro riferimento all’acquisizione della piattaforma da parte di Musk per 44 miliardi di dollari nel 2022 e un modo per sminuire l’offerta.

Cosa si intende per offerta ostile

Un’offerta d’acquisto ostile è una proposta di acquisizione di una società fatta contro la volontà del suo consiglio di amministrazione. In altre parole, l’azienda che riceve l’offerta (in questo caso OpenAI) non è d’accordo con la vendita, ma l’azienda offerente (qui Elon Musk e il suo consorzio) cerca comunque di ottenere il controllo.

Come funziona?

Quando un’acquisizione è amichevole, l’azienda acquirente negozia con il consiglio di amministrazione della società bersaglio, e insieme trovano un accordo sui termini di vendita.

Nel caso di un’offerta ostile, invece:

- Acquisto diretto delle azioni sul mercato: l’azienda acquirente cerca di comprare un numero sufficiente di azioni direttamente dagli azionisti, spesso offrendo un prezzo più alto rispetto al valore di mercato per convincerli a vendere.

- Proposta diretta agli azionisti (tender offer): Musk e il suo consorzio potrebbero fare un’offerta pubblica agli azionisti di OpenAI, bypassando il consiglio di amministrazione.

- Sostituzione del management: se OpenAI avesse azionisti con diritto di voto, Musk potrebbe cercare di ottenere il controllo cambiando il consiglio di amministrazione.

Perché Musk ha fatto un’offerta ostile?

- Non ha il supporto della dirigenza di OpenAI, che è guidata da Sam Altman.

- Vuole forzare la vendita, probabilmente per prendere il controllo della strategia aziendale.

- Potrebbe essere una vendetta o una mossa strategica, considerando la sua rivalità con Altman e il fatto di essere stato escluso dal progetto “Stargate”.

In sostanza, è una mossa aggressiva per ottenere il controllo di un’azienda che non vuole essere venduta.

Musk e la causa contro OpenAI

L’attacco di Musk a OpenAI non è un fulmine a ciel sereno. Già nel febbraio 2024, Musk aveva intentato una causa legale contro OpenAI, Altman e il presidente di allora, Greg Brockman, sostenendo che l’azienda avesse tradito la sua missione originaria. Secondo Musk, OpenAI era nata come una non-profit per il bene dell’umanità, ma con il tempo si è trasformata in un’azienda a scopo di lucro, legandosi sempre più strettamente a Microsoft.

Musk ha sempre sostenuto una visione dell’IA come tecnologia aperta e controllata, mentre Altman ha spinto OpenAI verso una struttura più commerciale, raccogliendo miliardi di investimenti e consolidando il proprio ruolo.

La causa intentata da Musk rappresenta quindi un ulteriore tassello di una lunga battaglia che arriva al suo punto più alto con l’offerta ostile.

La posizione di Sam Altman e OpenAI

Secondo The Hill, Altman ha ribadito che OpenAI non è in vendita e ha respinto l’idea che la società possa essere acquisita, definendo l’offerta di Musk come un’azione destinata a fallire. Il CEO ha sottolineato come l’azienda stia lavorando per garantire che l’intelligenza artificiale sia sviluppata in modo responsabile e che non intende cedere alle pressioni di Musk o di altri investitori.

Inoltre, secondo Axios, Altman avrebbe avuto il sostegno unanime del consiglio di amministrazione di OpenAI, che ritiene l’offerta ostile non solo inaccettabile ma anche dannosa per la missione dell’azienda.

Il board ha dichiarato che OpenAI continuerà a operare come entità indipendente, con una governance che privilegia la sicurezza e la trasparenza.

Perché Musk vuole OpenAI?

Se da una parte questa può sembrare una mossa dettata dall’ego e dalla rivalità personale, dall’altra non si può ignorare che OpenAI sia attualmente l’azienda più influente nel settore dell’intelligenza artificiale.

ChatGPT ha rivoluzionato il settore della generazione di contenuti, e i continui sviluppi della sua tecnologia lo rendono uno strumento chiave per il futuro dell’IA.

Musk, che ha già creato la sua startup xAI per competere nel settore, potrebbe voler riportare OpenAI alla sua visione originaria, oppure semplicemente fermare l’ascesa di un’azienda che sta diventando sempre più strategica per i suoi rivali, Microsoft in primis.

Quali saranno le prossime mosse?

Al momento, l’offerta ostile è stata respinta, ma Musk potrebbe provare a ottenere il controllo in altro modo, ad esempio cercando di convincere investitori e azionisti a sostenerlo. Nel frattempo, la battaglia legale tra Musk e OpenAI continua, e il futuro della società fondata nel 2015 sembra più incerto che mai.

Di sicuro, questa vicenda non è solo una questione di business, ma riguarda il futuro dell’intelligenza artificiale e il suo ruolo nel mondo.

Da oggi il futuro di OpenAI viaggia sulla via dell’incertezza.

[L’immagine di copertina è stata realizzata da @franzrusso utilizzando due diversi modelli di IA generativa. Imagen 3 per lo sfondo con la scritta AI e Grok per la generazione dei due profili di Musk e Altman]