Roskomnadzor limita Telegram in Russia per spingere gli utenti verso Max, app di sorveglianza statale. Ecco dove le piattaforme sono davvero vietate ed ecco perché censura e regolamentazione sono cose diverse.

Dal 10 febbraio 2026, Roskomnadzor, l’ente russo delle comunicazioni, ha iniziato a limitare il funzionamento di Telegram in tutto il Paese.

Gli utenti segnalano rallentamenti nel caricamento di immagini, video e messaggi vocali, mentre i messaggi di testo funzionano ancora. La versione mobile risulta più colpita di quella desktop.

Roskomnadzor giustifica la mossa con la presunta violazione delle leggi russe da parte di Telegram, accusando la piattaforma di non proteggere i dati personali e di non contrastare frodi e attività terroristiche. Ma chi segue da tempo le dinamiche del controllo digitale in Russia sa bene che questa giustificazione racconta solo una parte della storia.

Una stretta progressiva, non un fulmine a ciel sereno

Questa limitazione è solo l’ultimo capitolo di un percorso iniziato mesi fa. Ad agosto 2025, Mosca aveva già limitato le chiamate vocali e video su Telegram e WhatsApp, sostenendo che i servizi venivano usati per frodi e attività di sabotaggio. A ottobre ha bloccato le nuove registrazioni su entrambe le piattaforme. A dicembre ha colpito anche FaceTime e Snapchat.

Cos’è e come funziona Max, l’app governativa

Il vero obiettivo è spingere gli utenti russi verso Max, l’app di messaggistica sviluppata da VK con stretti legami con il Cremlino. Da settembre 2025, tutti gli smartphone venduti in Russia devono pre-installarla obbligatoriamente. Max si integra con i servizi governativi Gosuslugi e richiede numeri di telefono russi, con verifica dell’identità che probabilmente diventerà obbligatoria.

A differenza di Telegram, che usa la crittografia end-to-end, Max è progettata per consentire ai servizi di sicurezza russi l’accesso ai dati condivisi. In pratica, un vero sistema di sorveglianza camuffato da app di messaggistica. Un modello che ricorda molto da vicino quello che la Cina ha costruito con WeChat, dove ogni interazione digitale passa attraverso canali monitorabili dallo Stato.

La risposta di Pavel Durov

Pavel Durov, fondatore russo di Telegram che vive in esilio negli Emirati Arabi Uniti, ha risposto con decisione alla mossa di Roskomnadzor. Ha ricordato che otto anni fa l’Iran tentò la stessa strategia, vietando Telegram con pretesti inventati per spingere gli utenti verso un’alternativa statale. E fallì miseramente, perché gli utenti usarono VPN e altri strumenti per aggirare i blocchi.

“Limitare la libertà dei cittadini non è mai la risposta giusta. Telegram sta per libertà di parola e privacy, indipendentemente dalla pressione“, ha scritto Durov sul suo canale.

Una dichiarazione che riecheggia le battaglie che lo stesso Durov ha combattuto negli anni, da quando fu costretto a cedere VK (VKontakte), il social network russo che aveva fondato, proprio per le pressioni del Cremlino.

Da chi è gestita oggi VK – VKontakte

VK sta per VKontakte e questo nome ricorda la piattaforma social russa fondata proprio da Pavel Durov nel 2006, nata come alternativa a Facebook e che ne richiamava effettivamente il design e i colori blu.

Durov fu poi costretto a cederla nel 2014 sotto pressione del Cremlino, quando rifiutò di consegnare i dati degli utenti ucraini e di bloccare i gruppi di opposizione. Usò i proventi di quella vendita forzata per fondare Telegram dall’esilio negli Emirati.

VK oggi è di fatto controllata dallo Stato russo attraverso una struttura complessa. Nel dicembre 2021, Sogaz (compagnia assicurativa legata a Gazprom) e Gazprombank hanno acquisito il 57,3% delle quote di voto di VK dall’oligarca Alisher Usmanov.

Sogaz è in parte posseduta da Yuri Kovalchuk, amico personale di Putin e figura chiave nelle reti economiche del Cremlino.

Nel dettaglio, ecco chi gestisce VK oggi:

- Vladimir Kiriyenko è il CEO di VK. È il figlio di Sergei Kiriyenko, spesso definito braccio destro di Putin e responsabile del controllo politico sui “nuovi territori” russi (ossia i territori ucraini occupati).

- Stepan Kovalchuk è il vicepresidente responsabile della strategia media di VK. È il nipote di Yuri Kovalchuk, l’amico personale di Putin già citato sopra.

Quindi VK non è semplicemente “vicina al Cremlino”. È gestita direttamente da figli e nipoti del cerchio più stretto di Putin. E questa stessa VK è l’azienda che sviluppa Max, l’app che Roskomnadzor vuole sostituire a Telegram.

Il paradosso dei blogger pro-guerra

C’è un dettaglio che rende questa vicenda quasi paradossale e che merita attenzione. I blogger militari pro-guerra russi, quelli che sostengono l’invasione dell’Ucraina e comunicano dal fronte proprio attraverso Telegram, hanno criticato apertamente la decisione di Roskomnadzor.

Il canale Two Majors, uno dei più seguiti tra i corrispondenti militari russi, ha lamentato che ora le posizioni dal fronte saranno trasmesse “non dalla gente, ma dai nostri padroni del ministero degli esteri”. Anche Alexander Kots, altro corrispondente pro-guerra molto noto, ha fatto notare che bloccare Telegram limiterebbe le stesse “operazioni informative” russe e il reclutamento di ucraini attraverso l’app per compiere atti di sabotaggio.

Quando persino i sostenitori più accesi del regime criticano una decisione, significa che quella decisione colpisce interessi trasversali che vanno ben oltre le logiche di propaganda.

La reazione internazionale

Amnesty International ha definito la mossa “censura e ostruzione mascherate da protezione dei diritti dei cittadini”. Reporters Without Borders parla di “strategia per strangolare la circolazione dell’informazione” e ricorda che la Russia occupa il 171° posto su 180 nel World Press Freedom Index.

Telegram, 93 milioni di utenti in Russia

Telegram conta oltre 93 milioni di utenti attivi mensili in Russia, praticamente quanto WhatsApp. Nel corso del tempo l’app di messaggistica si è trasformata in un canale cruciale per media indipendenti, figure pubbliche e, ironia della sorte, per gli stessi organi governativi incluso lo stesso Roskomnadzor. Persino il ministero degli Esteri russo e la task force nazionale per il Covid hanno canali ufficiali su Telegram.

Ecco dove Telegram è davvero vietata

Per comprendere meglio il contesto, vale la pena ricordare dove Telegram è effettivamente vietata o fortemente limitata nel mondo.

La Cina ha bloccato Telegram nel 2015, dopo che attivisti per i diritti umani e avvocati avevano usato la piattaforma per organizzarsi.

L’Iran ha imposto il divieto nel 2018, accusando l’app di facilitare le proteste contro il governo e di diffondere contenuti “immorali”. Il Pakistan ha bloccato Telegram periodicamente, citando preoccupazioni sulla sicurezza informatica e la diffusione di fake news.

Nel 2025 si sono aggiunti altri Paesi. Il Vietnam ha vietato Telegram a maggio, accusandola di diffondere “documenti anti-Stato” e informazioni false.

Il Kenya ha imposto un blocco a giugno durante le proteste del 2025. Il Nepal ha seguito a luglio, motivando la decisione con preoccupazioni su frodi e riciclaggio di denaro. La Thailandia aveva già bloccato l’app nel 2020 perché usata per organizzare le proteste anti-governative.

La Somalia ha imposto un divieto nel 2023, sostenendo che la piattaforma veniva usata da gruppi terroristici e per diffondere contenuti espliciti.

Secondo i dati di Surfshark e Netblocks, dal 2015 a oggi 31 Paesi hanno vietato Telegram, temporaneamente o permanentemente, colpendo potenzialmente oltre 3 miliardi di persone a livello globale.

Il quadro più ampio: le piattaforme vietate nel mondo

Telegram non è un caso isolato. Il controllo delle piattaforme digitali è diventato uno strumento di governance per regimi autoritari e, in alcuni casi, anche per democrazie che affrontano sfide specifiche.

La Cina rappresenta l’esempio più strutturato di censura digitale. Dal 2009 ha bloccato X (allora Twitter), Facebook, YouTube, Instagram e molte altre piattaforme occidentali, costringendo i cittadini a usare alternative domestiche come WeChat, Weibo e Douyin (la versione cinese di TikTok). Il Great Firewall cinese rimane il sistema di controllo più sofisticato al mondo.

La Corea del Nord applica il modello più estremo in assoluto. L’accesso a Internet è riservato a pochissimi funzionari autorizzati e tutte le piattaforme globali sono inaccessibili. I cittadini comuni hanno accesso solo a una intranet governativa.

La Russia ha intensificato i blocchi dopo l’invasione dell’Ucraina nel febbraio 2022, vietando Facebook e Instagram (con Meta dichiarata “organizzazione estremista”) e limitando fortemente X. L’obiettivo dichiarato era contrastare la “disinformazione” sul conflitto, ma nella pratica si trattava di impedire ai russi di accedere a fonti di informazione non controllate dal Cremlino.

L’Iran blocca X e Facebook dal 2009, insieme a YouTube e molte altre piattaforme. Il Turkmenistan applica restrizioni simili, con uno dei punteggi più bassi al mondo in termini di libertà di Internet (2 su 100 secondo Freedom House).

Il Myanmar ha bloccato Facebook, X e Instagram dopo il colpo di Stato militare del febbraio 2021, cercando di controllare il flusso di informazioni sulle proteste e sulla repressione.

TikTok merita un discorso a parte. L’India l’ha vietata nel 2020 per ragioni di sicurezza nazionale, diventando il primo grande Paese a farlo. L’Albania ha imposto un divieto completo nel 2025, citando la violenza giovanile e l’instabilità sociale. Gli Stati Uniti hanno attraversato mesi di incertezza normativa, con TikTok brevemente sospesa a gennaio 2025 prima di ottenere una proroga di 75 giorni. Il Canada ha chiuso gli uffici di TikTok nel Paese per motivi di sicurezza nazionale, pur lasciando l’app accessibile agli utenti comuni.

Un caso interessante è quello del Brasile, che nell’agosto 2024 ha temporaneamente bloccato X dopo che Elon Musk si era rifiutato di nominare un rappresentante legale nel Paese e di rimuovere account accusati di diffondere odio e disinformazione legati ai sostenitori dell’ex presidente Bolsonaro. Il blocco è durato circa 40 giorni, fino a quando X ha pagato le multe (circa 5,2 milioni di dollari), nominato un rappresentante legale e rimosso i contenuti contestati. Un precedente significativo perché dimostra che anche le democrazie possono arrivare a bloccare piattaforme quando queste si rifiutano sistematicamente di rispettare le leggi locali.

La differenza tra censura e regolamentazione

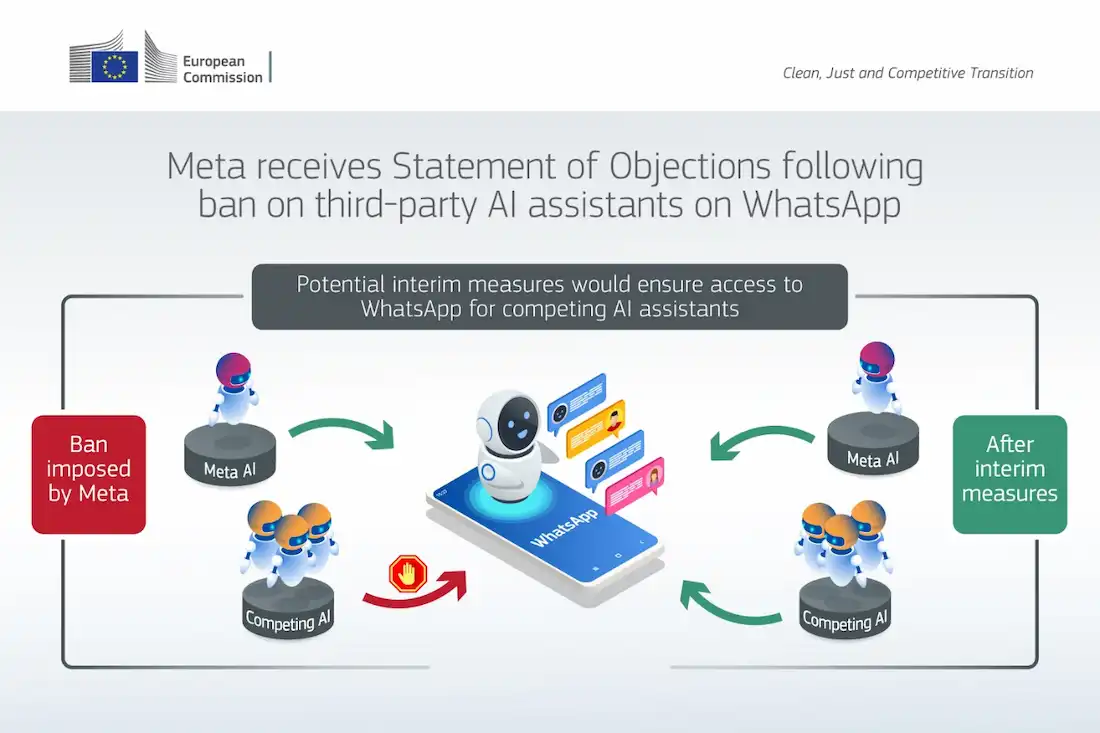

Questo caso russo dovrebbe rammentare quali sono i Paesi che davvero osteggiano e censurano le piattaforme. Un tema su cui spesso si fa molta confusione, soprattutto quando si parla di regolamentazione nell’UE.

Quando la Russia limita Telegram per spingere i cittadini verso un’app di sorveglianza statale, siamo di fronte a censura. Quando la Cina blocca tutte le piattaforme occidentali per controllare il flusso informativo, siamo di fronte a censura. Quando l’Iran vieta Telegram per reprimere le proteste, siamo di fronte a censura.

Quando invece l’UE chiede alle piattaforme di rispettare il Digital Services Act, di essere trasparenti sugli algoritmi, di rimuovere contenuti illegali e di proteggere i minori, siamo di fronte a regolamentazione democratica. Sono due cose profondamente diverse, anche se spesso vengono confuse nel dibattito pubblico.

La partita sul controllo dell’informazione digitale in Russia entra in una nuova fase. E ancora una volta, la libertà di comunicare diventa il campo di battaglia. Ma è fondamentale non perdere di vista le distinzioni: c’è chi blocca le piattaforme per controllare i cittadini e chi chiede alle piattaforme di rispettare regole democratiche. La differenza non è sottile, è sostanziale.