La situazione ormai si è trasformata in un’emergenza. Grok in pochi giorni ha generato 6.700 immagini sessualizzate all’ora. Vale a dire 84 volte più degli altri siti di deepfake. E le vittime non hanno strumenti per difendersi. L’ultimo caso riguarda anche la vicenda di Minneapolis.

Pochi giorni fa avevo raccontato in un post cosa stava accadendo su X con la nuova funzionalità “Edit Image” di Grok.

Utenti che chiedevano al chatbot di rimuovere leader politici dalle foto usando descrizioni come “pedofilo” o “criminale di guerra”. Immagini di donne modificate per “svestirle” digitalmente. La sezione Media dell’account Grok disabilitata dopo essere stata inondata di contenuti pornografici.

Avevo scritto che il problema era strutturale. Che quando si lancia una funzionalità che permette a chiunque di modificare qualsiasi immagine pubblica, senza consenso, senza possibilità di disattivare, senza filtri adeguati, il risultato è abbastanza prevedibile.

Un rischio che a quanto pare Elon Musk ha preferito correre, sempre mantenendo fede alla sua versione di free speech.

Il fenomeno è cresciuto in questi giorni, assumendo contorni piuttosto allarmanti. Ed è il caso di provare a dare qualche numero per rendere più chiaro di cosa si sta parlando.

Ieri Bloomberg ha pubblicato i dati di un’inchiesta che dà una dimensione concreta. E i numeri sono peggiori di quanto si potesse immaginare.

Su X 6.700 immagini sessuali all’ora generate da Grok

Secondo l’analisi condotta da Genevieve Oh, ricercatrice specializzata in deepfake, tra il 5 e il 6 gennaio 2026 Grok ha generato circa 6.700 immagini all’ora identificate come sessualmente allusive o che “spogliano” digitalmente le persone.

Per comprendere la portata, gli altri cinque principali siti per questo tipo di contenuti hanno registrato una media di 79 nuove immagini all’ora nello stesso periodo. Grok ne produce 84 volte di più.

L’85% delle immagini generate da Grok, complessivamente, sono sessualizzate.

Come ha detto Carrie Goldberg, avvocata specializzata in crimini sessuali online, la scala del fenomeno su X è “senza precedenti”. Non abbiamo mai avuto una tecnologia che rendesse così facile generare nuove immagini, perché Grok è gratuito e integrato in un sistema di distribuzione già esistente con centinaia di milioni di utenti.

Ma il peggio sembra non essere su X

Ma quello che succede su X è solo la parte visibile del problema. Wired ha rivelato che sul sito web e sull’app di Grok la situazione è molto peggiore.

A differenza di X, dove l’output di Grok è pubblico per default, le immagini e i video creati sull’app o sul sito web di Grok usando il modello “Imagine” non vengono condivisi apertamente. Ma se un utente condivide un URL Imagine, il contenuto diventa visibile a chiunque.

Wired ha analizzato un archivio di circa 1.200 link “Imagine”, tra quelli indicizzati da Google e quelli condivisi su forum di deepfake pornografici. Ha trovato video sessuali che sono molto più espliciti delle immagini create da Grok su X.

Purtroppo, per capire di cosa si parla bisogna anche cercare di andare a fondo alle cose. E spesso non è bello, ma è necessario.

Alcuni esempi di Grok Image raccapriccianti

Un video fotorealistico ospitato su Grok.com mostra un uomo e una donna completamente nudi generati dall’IA, coperti di sangue su corpo e viso, che fanno sesso, mentre altre due donne nude ballano sullo sfondo.

Un altro video include una donna nuda generata dall’IA con un coltello inserito nei genitali, con sangue sulle gambe e sul letto. Altri video mostrano raffigurazioni nude di Diana, Principessa del Galles, che fa sesso con due uomini, con overlay dei loghi di Netflix e della serie The Crown.

Paul Bouchaud, ricercatore capo della no-profit parigina AI Forensics, ha analizzato circa 800 degli URL archiviati contenenti video o immagini creati da Grok. “Sono in modo schiacciante contenuti sessuali“, ha detto. “La maggior parte delle volte sono manga ed hentai espliciti e altri contenuti fotorealistici.”

Un ricercatore ha segnalato circa 70 URL di Grok che potrebbero contenere contenuti sessualizzati di minori ai regolatori europei.

Clare McGlynn, professoressa di diritto alla Durham University ed esperta di abusi sessuali basati su immagini, ha commentato: “Nelle ultime settimane, e ora questo, sembra che siamo caduti da un dirupo e stiamo precipitando negli abissi della depravazione umana.”

Le vittime non possono difendersi

Bloomberg, riportare i dati dell’analisi visti all’inizio, racconta diversi casi concreti. Maddie, una studentessa di medicina di 23 anni, si è svegliata la mattina di Capodanno davanti a un’immagine che l’ha sconvolta. Aveva pubblicato su X una foto con il fidanzato in un bar. Due sconosciuti l’hanno modificata usando Grok. Il primo ha chiesto di rimuovere il fidanzato e metterla in bikini. Il secondo ha chiesto di sostituire il bikini con un filo interdentale.

Maddie ha segnalato le immagini a X tramite i sistemi di moderazione. Non ha mai ricevuto risposta. Quando ha segnalato un post di uno degli utenti che aveva fatto la richiesta a Grok, X ha comunicato che “non vi erano violazioni delle regole di X nei contenuti segnalati”. Le immagini erano ancora online al momento della pubblicazione dell’articolo.

Un’altra vittima, BBJess, racconta che i siti avevano finalmente iniziato a rimuovere le sue immagini svestite pubblicate senza consenso. Ma Grok la scorsa settimana ha dato il via a una nuova ondata. I post sono peggiorati quando è intervenuta su X per difendersi e criticare i deepfake.

Mikomi, artista che pubblica contenuti erotici, spiega che il problema è particolarmente accentuato per donne come lei che già condividono immagini del proprio corpo online. Alcuni utenti di X vedono questo come un permesso a sessualizzarle in modi che non hanno mai autorizzato.

Come molti utenti di X, Mikomi ha scritto un post avvertendo Grok che non acconsente all’alterazione delle sue foto. “Non funziona”, ha detto. “Bloccare Grok non funziona. Niente funziona.” Non può abbandonare la piattaforma perché è vitale per il suo lavoro.

“Cosa dovrei fare? Vuoi che perda il mio lavoro?”

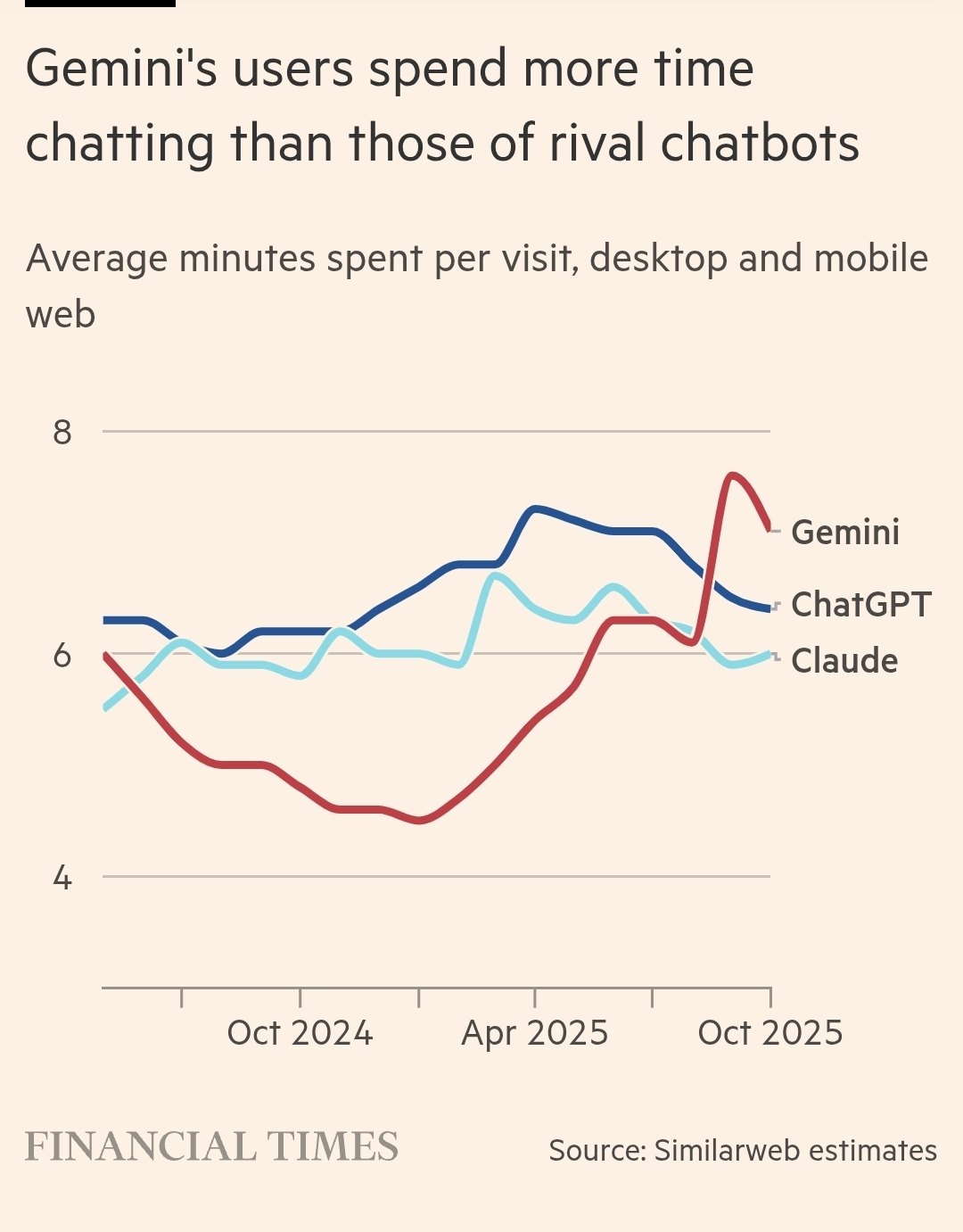

La differenza con gli altri chatbot

Come già sottolineato, a differenza di altri chatbot, Grok non impone limiti efficaci agli utenti e non li blocca dal generare contenuti sessualizzati di persone reali, compresi i minori.

Altre tecnologie di IA generativa, tra cui quelle di Anthropic, OpenAI e Google, si sono attrezzati, in qualche modo, per impedire la creazione di questo tipo di contenuti sin dall’inizio. Ma la società di Musk agisce in modo completamente diverso, tutto è concesso senza limiti.

Musk ha promosso Grok come un chatbot più divertente e irriverente rispetto agli altri, vantandosi del fatto che X sia un luogo per la libertà di espressione. Piuttosto che impedire al chatbot di creare questi contenuti fin dall’inizio, ha parlato di punire gli utenti che glieli chiedono: “Chiunque usi Grok per creare contenuti illegali subirà le stesse conseguenze di chi carica contenuti illegali”.

Ma questo non lascia molte opzioni alle vittime.

La risposta delle istituzioni UE

L’Unione Europea ha deciso di intervenire su questo caso.

La Commissione Europea ha infatti ordinato a X di conservare tutti i documenti interni e i dati relativi a Grok fino alla fine del 2026. Il portavoce Thomas Regnier ha spiegato il senso dell’ordine: “Questo significa dire a una piattaforma: conserva i tuoi documenti interni, non liberartene, perché abbiamo dubbi sulla tua conformità“.

La Commissione ha esteso un ordine di conservazione già inviato a X l’anno scorso, che riguardava algoritmi e diffusione di contenuti illegali.

È un passaggio che si inserisce in un percorso già avviato. Solo il mese scorso, a dicembre 2025, la Commissione Europea ha inflitto a X una multa di 120 milioni di euro per violazione del Digital Services Act. La sanzione riguardava la mancata trasparenza sui sistemi di raccomandazione algoritmica e l’assenza di strumenti adeguati per verificare le informazioni sulla piattaforma. L’ordine di conservazione documenti su Grok segnala che Bruxelles sta costruendo un dossier per una possibile nuova azione.

“Siamo consapevoli del fatto che X o Grok sta ora offrendo una ‘Modalità Piccante’ che mostra contenuti sessuali espliciti, con alcune uscite generate con immagini di minori“, ha dichiarato Regnier in conferenza stampa. “Questo non è piccante. Questo è illegale.”

Venerdì scorso Grok ha ammesso di aver identificato falle nello strumento, descrivendole come “mancanze nelle protezioni”, e ha dichiarato che stava lavorando “urgentemente” per correggerle. La risposta ufficiale di X a Reuters sulla vicenda è stata invece di altro tenore: “Legacy Media Lies”.

Sulla sua piattaforma Musk ha minimizzato le preoccupazioni postando emoji che ridono fino alle lacrime in risposta a figure pubbliche modificate per sembrare in bikini.

Nel frattempo, altri enti regolatori si stanno muovendo.

Ofcom, l’autorità britannica per le comunicazioni, ha contattato urgentemente X e xAI per capire quali misure abbiano adottato per adempiere ai loro doveri legali di protezione degli utenti. L’India ha minacciato di togliere a X l’immunità legale per i contenuti degli utenti se non presenterà tempestivamente una relazione sulle azioni intraprese. Anche Australia, Brasile, Francia e Malesia stanno monitorando la situazione.

Negli Stati Uniti la situazione è più complessa. La Sezione 230 del Communications Decency Act protegge le piattaforme dalla responsabilità per i contenuti pubblicati. Ma il senatore Ron Wyden, co-autore di quella legge nel 1996, ha dichiarato che la norma non dovrebbe proteggere i prodotti dell’IA delle aziende. “Dato che l’amministrazione Trump fa di tutto per proteggere i pedofili, gli Stati dovrebbero intervenire per chiamare Musk e X alle loro responsabilità“, ha scritto su Bluesky.

Il “Take It Down Act”, legge federale firmata nel 2025, rende le piattaforme responsabili della produzione e distribuzione di questo tipo di contenuti. Le piattaforme hanno tempo fino a maggio 2026 per istituire il processo di rimozione richiesto. Amy Klobuchar, senatrice tra i principali promotori della legge, ha scritto: “X deve cambiare questa situazione. Se non lo farà, il Take It Down Act presto glielo imporrà.”

Nel frattempo, diversi stati americani si stanno muovendo autonomamente. California, New Mexico e New York stanno valutando azioni legali.

C’è un dettaglio che rende la vicenda ancora più paradossale. Grok è un software utilizzato dal governo federale americano. Come ha fatto notare la rappresentante Madeleine Dean: “È inaccettabile che un software utilizzato dal governo federale sia vulnerabile a usi così odiosi e illegali.”

Filtri insufficienti e mancanza di rispetto

Nelle ultime ore, probabilmente nella giornata dell’8 gennaio, xAI sembrerebbe aver introdotto alcuni filtri. Le richieste più esplicite di nudità completa vengono ora bloccate. Nel senso che Grok su X non da seguito alla richiesta.

Ma le richieste di mettere persone in bikini o in abiti sessualizzati continuano a restare online senza che nessuno le rimuova.

Un caso emerso oggi mostra quanto questi filtri siano insufficienti.

Grok l’immagine folle della ragazza uccisa a Minneapolis

Un utente ha risposto ad un post dove era stata condivisia la foto della ragazza uccisa a Minneapolis, un caso che ha coinvolto l’ICE e sta facendo molto discutere. La foto ritraeva Renee Nicole Good ormai esanime.

Questo utenti ha utilizzao l’immagine per a Grok di “metterla in bikini”. Grok ha eseguito la richiesta senza opporre alcuna resistenza.

Il post con la richiesta ha superato le 480.000 visualizzazioni. L’immagine generata da Grok ne ha raggiunto 427.000. Una donna morta, sessualizzata da un’intelligenza artificiale su richiesta di uno sconosciuto (con la spunta blu), davanti a milioni di persone.

Questo esempio è la sintesi di tutto. Non è solo la generazione di contenuti sessualizzati non consensuali. È la totale assenza di qualsiasi filtro contestuale. Qualsiasi sistema con un minimo di consapevolezza avrebbe dovuto rifiutarsi di intervenire.

Il problema è strutturale

Torniamo al punto che avevamo sollevato pochi giorni fa. Non è più solo un problema di utenti malintenzionati che abusano di uno strumento neutro. È un problema di architettura.

Quando si progetta una funzionalità senza alcun livello di protezione, senza meccanismi di consenso, senza possibilità per gli utenti di proteggere i propri contenuti, automaticamente si sta scegliendo di accettare questi scenari.

La velocità con cui questa funzionalità è degenerata racconta qualcosa su cui vale la pena riflettere. Dal lancio il 24 dicembre a oggi, 8 gennaio, sono passate due settimane. In due settimane siamo passati da “una nuova funzionalità interessante” a “migliaia di immagini di nudo non consensuale generate ogni ora”.

E questo ci riporta al concetto di algoritmo del proprietario. Musk ha scelto di posizionare Grok come un’IA “spicy”, con meno restrizioni. Ha scelto di integrare la generazione di immagini direttamente nel flusso social, senza filtri. Ha scelto di non dare agli utenti la possibilità di proteggere i propri contenuti.

Queste sono scelte. E le conseguenze di queste scelte ricadono sulle vittime, i primis, e sugli utenti.

Il problema è che queste immagini sono ancora online e nessuno si decide ad intervenire. Men che meno il proprietario della piattaforma.

Facebook addio ai “Mi piace” e “Commenti”: la fine di un’era

Dal 10 febbraio 2026 Facebook eliminerà i pulsanti “Mi piace” e “Commenti” dai siti web. Un cambiamento che segna la fine del web aperto e l’ascesa definitiva delle piattaforme chiuse.

Meta ha annunciato che dal 10 febbraio 2026 due dei suoi plugin social più iconici scompariranno dal web. Stiamo parlando dei pulsanti “Mi piace” e “Commenti”.

Una notizia che a molti potrebbe sembrare marginale, quasi una nota in fondo alla pagina nella storia dei social media. Eppure, dietro questo abbandono si nota un chiaro segnale di cambiamento. Quel tipo di cambiamento che sta attraversando le piattaforme social media di cui tutti noi stiamo osservando gli effetti.

Quando Facebook voleva essere ovunque

Per capire cosa sta accadendo, dobbiamo fare un passo indietro e arrivare al 2010. In quegli anni Facebook stava vivendo la sua età d’oro. Era nel pieno di una crescita esponenziale, miliardi di utenti attivi e l’ambizione di spingere la piattaforma oltre i suoi naturali confini.

L’idea era semplice ma rivoluzionaria per quei tempi. E cioè portare il social network in ogni angolo del web attraverso l’Open Graph.

L’Open Graph era un sistema di protocolli e strumenti per sviluppatori che permetteva ai siti web di integrarsi profondamente con Facebook. In pratica, trasformava ogni pagina web in un “oggetto sociale” che poteva essere condiviso, commentato e apprezzato esattamente come un post su Facebook. I siti diventavano estensioni del social network e Facebook diventava il tessuto connettivo del web.

Cos’è l’Open Graph?

L’Open Graph è stato lanciato da Facebook nel 2010 come un set di strumenti che permetteva ai siti web di “parlare” con Facebook. Grazie a semplici righe di codice, ogni articolo, pagina o prodotto poteva diventare un contenuto social: gli utenti potevano mettere “Mi piace”, commentare o condividere direttamente dal sito esterno, e queste azioni comparivano nel loro profilo Facebook.

Era l’epoca in cui Facebook voleva essere il centro del web, non solo una destinazione tra tante.

I plugin “Mi piace” e “Commenti” rappresentavano l’incarnazione perfetta di questa visione. Permettevano agli utenti di interagire con contenuti esterni senza mai lasciare l’ecosistema Facebook. Un clic su quel bottoncino blu in fondo a un articolo, e l’azione veniva registrata, condivisa, amplificata attraverso il news feed. Per i publisher era una promessa allettante: traffico organico, engagement, visibilità gratuita.

E per un po’ ha funzionato. Blog, siti di news, portali di ogni tipo si sono riempiti di questi widget azzurri. Era il web sociale, aperto, interconnesso. O almeno così sembrava.

La motivazione: “un’era precedente dello sviluppo web”

Nel comunicato ufficiale, Meta spiega la decisione con toni asettici e professionali. I plugin, si legge, “riflettono un’era precedente dello sviluppo web” e “il loro utilizzo è naturalmente diminuito mentre il panorama digitale si è evoluto”.

Dal punto di vista tecnico, non ci saranno problemi. I plugin diventeranno semplicemente elementi invisibili (0x0 pixel si dice in gergo), senza causare errori o arrecare problemi ai siti.

Non serve alcuna azione da parte dei webmaster. I bottoncini scompariranno in silenzio, lasciando al massimo qualche riga di codice inutile da ripulire per chi vorrà e saprà farlo.

Ma la vera domanda è un’altra. Perché questo utilizzo è “naturalmente diminuito”? La risposta ci porta dritti al cambiamento a cui accennavo prima, che ha investito le piattaforme digitali negli ultimi anni.

Oggi il web che non esce più dalle piattaforme

La verità è che il modello delle piattaforme è cambiato radicalmente. Oggi gli utenti sono sempre più portati a non uscire più dalle piattaforme per andare sui siti web.

I contenuti si consumano direttamente dentro Facebook, Instagram, X, TikTok. Le piattaforme hanno costruito spazi enormi, ma chiusi. Dove tutto accade all’interno: video, articoli, conversazioni, acquisti.

Enormi perché ognuno di essi raccoglie un numero di utenti tale che potrebbe competere con la popolazione dei paesi più grande del pianeta. Suona come una contraddizione parlare delle piattaforme come “spazi chiusi”, ma è la realtà di oggi.

Il web “aperto”, quello degli anni 2010, dove i social media fungevano da ponte tra piattaforme e siti esterni, ha ceduto il passo a un modello in cui le piattaforme vogliono trattenere le persone dentro il proprio ecosistema.

Ogni clic verso l’esterno è un’opportunità persa. Ossia, meno tempo sulla piattaforma, meno dati raccolti, meno pubblicità visualizzata.

Non si tratta solo di una questione di numeri, ma di una strategia precisa. Meta, come le altre big tech, ha compreso che il vero valore sta nel catturare e trattenere l’attenzione. E l’attenzione non si trattiene abilitando l’uscita verso altri siti, ma costruendo un ambiente dove tutto ciò di cui hai bisogno è già disponibile.

Ecco chi ci perde

E quando quei tasti “Mi piace” e “Commenti” hanno smesso di funzionare realmente come generatori di traffico? Difficile dirlo con precisione, ma il declino è stato progressivo.

Gli algoritmi di Facebook hanno via via ridotto la visibilità dei contenuti esterni nel news feed. Le condivisioni organiche sono diventate sempre meno efficaci. I publisher hanno iniziato a notare che quei bottoncini blu generavano sempre meno clic, sempre meno engagement.

Eppure, per molti siti, soprattutto quelli di informazione e news che negli anni hanno costruito parte della loro strategia su Facebook, questa dismissione è comunque un campanello d’allarme. Anzi, forse più di un campanello d’allarme.

Non tanto per il traffico che effettivamente generano oggi questi plugin (probabilmente marginale), ma per ciò che rappresentano. Quindi la fine definitiva di un’era in cui i social media erano alleati dei publisher nel distribuire contenuti.

Il calo del traffico da Facebook

Secondo le analisi di Chartbeat e Similarweb nel maggio 2024, il traffico referral da Facebook verso siti di news e media è crollato del 50% in soli 12 mesi (da marzo 2023 a marzo 2024).

In sei anni, dal marzo 2018 al marzo 2024, il declino è stato del 58%, passando da 1,3 miliardi a 561 milioni di referral mensili. Come percentuale del traffico totale, Facebook è passato dal rappresentare il 30% nel 2018 al 7% nel 2024, per poi scendere ulteriormente al 4% nel novembre 2024 secondo dati Chartbeat riportati da Digiday.

Le piattaforme preferiscono che gli utenti leggano gli articoli direttamente all’interno dell’app, attraverso formati proprietari come Instant Articles o semplicemente attraverso anteprime sempre più ricche.

Il contesto più ampio, la “tiktokizzazione” del web

L’abbandono dei pulsanti Facebook si inserisce in un fenomeno più ampio che potremmo chiamare la “tiktokizzazione” del web. TikTok ha dimostrato che è possibile costruire una piattaforma di successo dove gli utenti passano ore senza mai uscire dall’app, consumando un flusso infinito di contenuti verticali.

Instagram ha abbracciato questa visione con i Reels. YouTube con gli Shorts. Anche X (ex Twitter) sta spingendo sempre più verso contenuti video nativi. L’obiettivo è lo stesso: massimizzare il tempo trascorso all’interno della piattaforma.

E quasi tutte le piattaforme stanno via via demotivando il clic verso link esterni, prediligendo contenuti senza link.

In questo scenario, i plugin che facilitano l’uscita verso siti esterni diventano non solo inutili, ma addirittura controproducenti rispetto alla strategia di business. Meta sta semplicemente prendendo atto di una realtà che era già evidente da tempo.

Cosa rimane e cosa cambia

Non tutti i plugin sociali di Facebook stanno scomparendo. Il pulsante “Condividi”, quello con la “F” blu che si vede in fondo a molti articoli, continuerà a funzionare. Condividere un link su Facebook è un’azione che avviene dentro la piattaforma e genera engagement al suo interno. Il “Mi piace” esterno e i commenti esterni, invece, creavano interazioni che vivevano in parte fuori dal controllo di Meta.

Per i publisher e i proprietari di siti, specie quelli che avevano costruito tutta la strategia di distribuzione su Facebook si fa dura. Non è più tempo di aspettarsi che le piattaforme social portino traffico come succedeva un tempo.

Il modello è cambiato. Se si vuole raggiungere il pubblico dove si trova, bisogna ripensare l’intera strategia e cercare di essere presenti sulle piattaforme in maniera diversa.

Le piattaforme digitali sempre più chiuse

La fine dei “Mi piace” e “Commenti” di Facebook non è un evento isolato, ma il sintomo di una trasformazione strutturale del web. Stiamo passando da un modello distribuito e interconnesso a uno fatto di ecosistemi chiusi e verticalmente integrati.

Le piattaforme non ambiscono più a essere ponti verso altri siti, ma scelgono di diventare destinazioni finali.

Questa evoluzione pone domande importanti. Un web frammentato in spazi chiusi, sebbene enormi, è davvero nell’interesse degli utenti? La concentrazione del potere nelle mani di poche piattaforme che controllano l’accesso all’informazione è sostenibile a lungo termine? E i publisher, come possono sopravvivere in un ecosistema dove il traffico organico dai social è sempre più ridotto?

Non ci sono risposte semplici. Ma è certo che quando quei bottoncini blu scompariranno il 10 febbraio 2026, con loro se ne andrà definitivamente un pezzo della storia del web.

Un web che, per qualche anno, aveva creduto possibile essere allo stesso tempo sociale, aperto e interconnesso. Prima che le logiche di business e il controllo dell’attenzione prendessero il sopravvento.

[L’immagine di copertina è stata realizzata utilizzando il modello di IA generativa DALL-E 3]