L’IA generativa non è più solo una chatbot, è molto di più. Il lancio di Grok di xAI, insieme a ChatGPT Turbo rappresentano una evoluzione che impone oggi una seria riflessione sulle implicazioni che l’IA generativa più avere su larga scala.

In un mondo in cui la tecnologia si evolve a passi da gigante, l’intelligenza artificiale (IA) si è affermata come una delle forze più trasformative del nostro tempo. Non più relegata alle pagine di romanzi di fantascienza o ai laboratori di ricerca. L’IA generativa ha fatto irruzione nella vita quotidiana, promettendo di rivoluzionare ogni aspetto della nostra esistenza. Dalle auto che si guidano da sole alle assistenti virtuali che gestiscono le nostre case, l’IA sta ridefinendo il concetto di automazione e interazione uomo-macchina.

Un futuro che è già presente. E porta a fare delle considerazioni di tipo economico, sociale ed etico per comprendere meglio quello che sta per arrivare.

Il recente OpenAI Day ha segnato un momento storico in questa rapida evoluzione. Con l’annuncio di ChatGPT Turbo, un’innovazione che promette di accelerare ulteriormente l’integrazione dell’IA nella società. Questo sviluppo segue il lancio di Grok da parte di xAI, un altro pioniere nel campo dell’IA generativa. Grok ha introdotto nuove possibilità di interazione e comprensione tra umani e macchine. Qui esploreremo il panorama attuale dell’IA generativa, delineando come queste tecnologie stanno plasmando il nostro futuro.

Mentre ci avventuriamo in questa nuova era, è essenziale comprendere non solo le capacità tecniche di sistemi come Grok e ChatGPT Turbo. Ma anche il contesto più ampio in cui queste innovazioni stanno emergendo. In questo contesto vedremo come Grok e ChatGPT Turbo rappresentano i più recenti balzi in avanti in questo campo dinamico. E certamente da qui inizia una nuova era dell’IA generativa sempre più performante e precisa.

Il panorama attuale dell’IA Generativa

L’IA generativa ha superato il semplice riconoscimento di immagini e testo, evolvendo in sistemi capaci di creare contenuti, risolvere problemi complessi e interagire con gli utenti in modi sempre più sofisticati. Questo campo si è espanso per includere la generazione di linguaggio naturale, la creazione di arte e musica, e persino la simulazione di dialoghi umani. Con ogni innovazione, l’IA generativa si avvicina sempre di più a replicare la complessità e la creatività umana. E in alcuni casi anche l’emotività.

Grok: la promessa di xAI, e di Elon Musk

Grok, sviluppato da xAI, rappresenta un salto qualitativo nell’IA generativa. Con i suoi 33 miliardi di parametri, mira a simulare la curiosità innata e le capacità di apprendimento simili a quelle umane. Grok è progettato per interagire e comprendere con un livello di profondità e naturalezza senza precedenti.

Come chatbot AI, risponde a domande e fornisce insight su una vasta gamma di argomenti, sfruttando la piattaforma X (quella che un tempo era Twitter) per un accesso in tempo reale a informazioni globali. Il suo lancio segna il primo rilascio pubblico di xAI nel settore degli strumenti di IA generativa.

Il nome “Grok” fa riferimento al romanzo di fantascienza “Guida galattica per autostoppisti” di Douglas Adams. Qui “grok” significa comprendere qualcosa in modo profondo e intuitivo.

Va anche detto che il termine informale grok è stato un’invenzione dello scrittore di fantascienza Robert A. Heinlein, il cui romanzo di fantascienza del 1961 Straniero in terra Straniera attribuiva grande importanza al concetto di grokking. Nel libro, grok significa entrare in empatia così profondamente con gli altri da fondersi o fondersi con loro.

Elon Musk ha introdotto Grok come la sua risposta a ChatGPT, con l’obiettivo di competere nel campo dell’intelligenza artificiale. Grok è progettato per rispondere alle domande con uno spirito arguto e ha un carattere ribelle. Molto in linea con lo spirito della “Guida galattica per autostoppisti”. E in linea con il suo fondatore, Elon Musk.

ChatGPT Turbo: l’Innovazione di OpenAI

OpenAI, noto per il suo lavoro pionieristico nell’IA conversazionale, ha recentemente annunciato ChatGPT Turbo durante l’OpenAI Day. Questa nuova interazione del modello GPT-4 è stata migliorata con funzionalità avanzate. Come una finestra di contesto più ampia e una maggiore efficienza dei costi.

ChatGPT Turbo è stato progettato per essere più veloce, più intuitivo e più accessibile, rendendolo un’opzione attraente per gli sviluppatori e le aziende che cercano di integrare l’IA nelle loro operazioni.

ChatGPT Turbo fa riferimento a una versione ottimizzata dei modelli GPT-3.5 e GPT-4 per le interazioni via chat. OpenAI ha sviluppato l’API di completamento chat, che utilizza il Chat Markup Language (ChatML), come metodo preferito e unico per accedere a questi modelli più avanzati, inclusa la versione GPT-4 Turbo.

Il modello gpt-3.5-turbo è il più capace ed economico della famiglia GPT-3.5 ed è stato ottimizzato per le chat utilizzando l’API Chat completions, ma è adatto anche per compiti di completamento tradizionali. Durante il DevDay, Sam Altman, CEO di OpenAI, ha annunciato la nuova versione avanzata del modello ChatGPT chiamata GPT-4 Turbo, che presenta una maggiore capacità di gestione del contesto.

GPT-3.5 Turbo offre agli sviluppatori un modello stabile raccomandato, con la flessibilità di scegliere una versione specifica del modello. Ad esempio, è stata rilasciata la versione gpt-3.5-turbo-0301, che sarà supportata fino almeno al 1° giugno, e ci saranno aggiornamenti futuri per mantenere il modello stabile e aggiornato.

Inoltre, OpenAI ha riferito che ChatGPT ha raggiunto 100 milioni di utenti attivi settimanali e ha lanciato il nuovo modello di intelligenza artificiale GPT-4 Turbo per gli sviluppatori, capace di analizzare oltre 300 pagine di testo. Queste innovazioni mostrano l’impegno di OpenAI nel migliorare costantemente le capacità e la portata dei suoi modelli di linguaggio AI.

Confronto tra Grok e ChatGPT Turbo

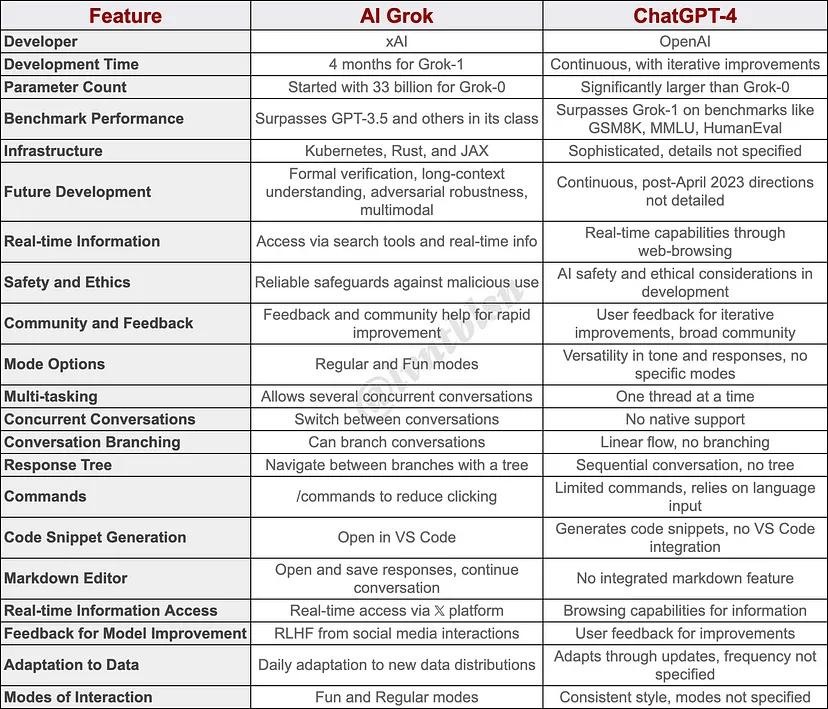

Mentre Grok si concentra sulla comprensione profonda e sull’apprendimento, ChatGPT Turbo si distingue per la sua velocità e la sua capacità di gestire un contesto più ampio.

Grok potrebbe eccellere nell’adattamento e nella personalizzazione. Mentre ChatGPT Turbo potrebbe essere la scelta migliore per applicazioni che richiedono risposte rapide e precise su larga scala. Entrambi i sistemi rappresentano il vertice dell’IA generativa, ma con filosofie e punti di forza distinti.

Il grafico in alto mette a confronto le due intelligenze, subito dopo il lancio di Grok. E quindi subito prima del lancio di ChatGPT Turbo. Potrebbe quindi non contenere più informazioni aggiornate, ma resta comunque utile per avere un’idea di confronto.

Il futuro dell’IA Generativa

Il futuro dell’IA generativa è ricco di potenzialità, un dato fuor di dubbio. Con l’accelerazione del progresso tecnologico, possiamo aspettarci che l’IA diventi più integrata nella vita quotidiana. Capace di offrire soluzioni personalizzate e migliorando l’efficienza in vari settori.

La sfida sarà garantire che queste tecnologie siano sviluppate in modo etico e responsabile, con una considerazione attenta per l’impatto sulla società e sull’occupazione.

L’annuncio di ChatGPT Turbo da parte di OpenAI e il lancio di Grok da parte di xAI rappresentano momenti significativi nella storia dell’IA generativa.

Mentre queste tecnologie continuano a evolversi, è chiaro che stiamo entrando in una nuova era dell’intelligenza artificiale. Una nuova era che promette di ridefinire il nostro rapporto con la tecnologia e di ampliare i confini di ciò che è possibile.

Il futuro dell’IA è non solo brillante ma anche imprevedibile. Sta a noi navigare in questo futuro con cura e attenzione.

Di certo, serve lavorare anche da punto di vista della regolamentazione di questo fenomeno, talmente veloce e potente. E con altrettanta forza e velocità, serve intervenire perché questi strumenti restino tali. E che non diventino occasioni per riempire dei vuoti che saranno difficili da governare.

Quasi sempre di fronte a tali innovazioni è facile perdere la bussola del ragionamento, abbandonandosi in tutto e per tutto. Lo abbiamo già visto coi social media: da strumenti di comunicazioni in poco tempo sono diventati anche contenitori di esistenze. E i risultati sono sotto gli occhi si tutti.

Ma adesso la posta in gioco è ancora più alta. Serve attenzione, misura, concentrazione, curiosità e responsabilità, oltre che consapevolezza.

Dimostriamo a noi stessi di aver imparato la lezione e cominciamo a governare questo fenomeno, prima che questi finiscano per governare le nostre esistenze.